12306.cnЮовЩЪЧШЋЧђзюЗБУІЕФЭјеОЃЌУПЕНЬиЪтНкШеЃЌетИіЪРНчЩЯЙцФЃзюДѓЕФЪЕЪБНЛвзЯЕЭГЖМвЊУцСйОоДѓПМбщЁЃ2012ФъГѕЕФДКдЫИпЗхЦкМфЃЌУПЬьга2000ЭђШЫЗУЮЪИУЭјеОЃЌШеЕуЛїСПзюИпДяЕН14вкЃЌДѓСПЭЌЪБгПШыЕФЭјТчЗУЮЪдьГЩ12306МИНќЬБЛОЁЃ

ЁЁЁЁЮЊСЫИФБфЁАЗъНкБиЬБЁБЕФЯжзДЃЌЬњТЗзмЙЋЫОДг2012Фъ6дТПЊЪМбЁдёPivotal GemFireЗжВМЪНФкДцМЦЫуЦНЬЈЖд12306НјааИФдьЁЃШчНё3ФъЙ§ШЅЃЌ2015ФъЬњТЗПЭЦБЕФДКдЫдчвбНсЪјЃЌВЛФбЗЂЯжЃЌгыЭљФъЯрБШНёФъДѓМвЖд12306ЭТВлЕФЛЈБпаТЮХЩйСЫКмЖрЁЃ

ЁЁЁЁдкЕкСљНьжаЙњЪ§ОнПтММЪѕДѓЛс(DTCC 2015)ЕФЁАФкДцЪ§ОнПтзЈГЁЁБжаЃЌжаЙњПЦбЇдКздЖЏЛЏбаОПЫљДѓЪ§ОнгІгУВПИпМЖбаОПдБбюаёОћЮЊЮвУЧЯъОЁНтЖССЫGemFireЪЧШчКЮАяжњ12306АкЭбЁАБЅЪмкИВЁЁБЕФУќдЫЁЃ

ЁЁЁЁ

ЁЁЁЁЁјжаЙњПЦбЇдКздЖЏЛЏбаОПЫљДѓЪ§ОнгІгУВПИпМЖбаОПдБбюаёОћ

ЁЁЁЁЛиЙЫGemFireЕФЧАЪРНёЩњ

ЁЁЁЁ1982Фъ

ЁЁЁЁGemStone SystemsГЩСЂгкУРЙњЖэРеИджнЮїББВПГЧЪаБШИЅЖйЪаЁЃGemStoneЪЧСьЯШЕФЗжВМЪНЪ§ОнЙмРэММЪѕШэМўЙЋЫОЃЌдкДЫЗНУцгазХКёжиЕФРњЪЗЁЃзюГѕЪЙгУSmalltalkгябдПЊЗЂГіСЫЕквЛДњУцЯђЖдЯѓЕФЪ§ОнПтЁЃВЂГЩЮЊSmalltalkжДааЮЏдБЛсГЩдБЁЃ

ЁЁЁЁ1986Фъ

ЁЁЁЁЕквЛДњВњЦЗGemstone/S е§ЪНУцЪРЃЌЪмЕНН№ШкЪаГЁЕФЙуЗКЛЖгЁЃ

ЁЁЁЁ90ФъДњжаКѓЦк

ЁЁЁЁЫцзХJavaгябдЕФЙуЗКгІгУЃЌGemStoneгыSunЙЋЫОКЯзїЃЌВЮгыЕНJEEЕФЙцЗЖжЦЖЈ(JCache -JSR107)ЃЌВЂТНајИќаТгыJEEЦНЬЈЯрНсКЯЕФВњЦЗЁЃGemStoneПЊЗЂГіСЫGemFireЃЌГЩЮЊвЕНчЕквЛИіТњзуJ2EEБъзМЕФжаМфМўЁЃGemFireгЕгаШЋаТЕФгІгУПђМмЃЌМцШнJava, C++, C#ЁЃЖјGemFireдкCEP(complex event processing)ЃЌEvent Stream ProcessingЃЌData VirtualizationЃЌ Distributed CachingМИИіЗНУцгазХОйзуЧсжиЕФЕиЮЛЁЃ

ЁЁЁЁ2008ФъГѕ

ЁЁЁЁН№ШкЮЃЛњКѓЃЌН№ШкМрЙмЗЈЙцDodd-FrankЁЂBasel3ЕШТНајГіЬЈЃЌИїДѓЭЖзЪвјааЮЊСЫМѕЩйЯЕЭГЗчЯеКЭдіМгЭИУїЖШЃЌМгЧПСЫН№ШкбмЩњЦЗНЛвзЦНЬЈЕФЭЖзЪЙцФЃЃЌGemfireЛїАмOracleЕШРЯХЦГЇЩЬЃЌѕвЩэЮЊЛЊЖћНжЕквЛДѓЗжВМЪНЪ§ОнДІРэЦНЬЈШэМўЁЃ

ЁЁЁЁ2010Фъ5дТ

ЁЁЁЁVMwareЪеЙКСЫРЯХЦГЇЩЬGemstoneЃЌВЂШыSpringSourceВПУХЁЃ

ЁЁЁЁ12306ЕФЁАЫЋИпЬєеНЁБ

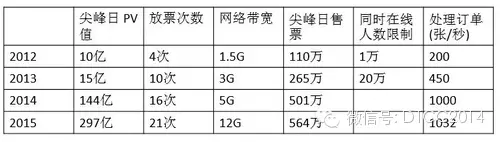

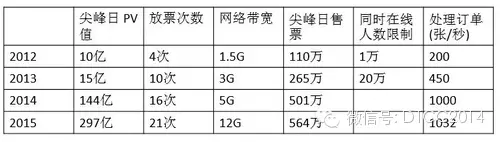

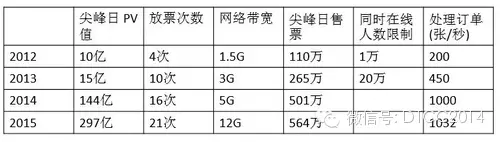

ЁЁЁЁОнбюаёОћНщЩмЃЌдк2015ФъДКдЫИпЗхШеЃЌ12306ЕФPVжЕЪЧ297вкЃЌСїСПНЯЦНЪБдіМг1000БЖЁЃ

ЁЁЁЁ12306зїЮЊвЛИіУцЯђЙЋжкЕФЯЕЭГ,ЛЅСЊЭјЪлЦБЯЕЭГОпБИЫљгаДѓаЭЛЅСЊЭјЯЕЭГЕФЬиад:ЁАИпВЂЗЂЁБ, ЁАИпСїСПЁБЁЃгШЦфЪЧдкЮвЙњЕФИїИіНкМйШе,ЯЕЭГЕФЗУЮЪСПЛсМЄді,ЕМжТећИіЯЕЭГКѓЬЈбЙСІЙ§Дѓ,ЯьгІБфТ§ЁЃ

ЁЁЁЁ

ЁЁЁЁЁјДЋЭГЙиЯЕаЭЪ§ОнПтЫљУцСйЕФЬєеН

ЁЁЁЁгаЭјгбЕїйЉЫЕЃЌ12306ЦфЪЕвВЪЧвЛИіЕчЩЬЦНЬЈЃЌЖјЧвЪЧШЋЧђзюИДдгЁЂЙцФЃзюДѓЕФЕчЩЬЦНЬЈЁЃЕЋЪЕМЪЩЯЃЌ12306БГКѓЫљвўВиЕФвЕЮёТпМЗЧГЃИДдгЃЌдЖдЖГЌЙ§вЛАуЕФЕчЩЬЦНЬЈЁЃ

ЁЁЁЁЖдгкЕчзгЩЬЮёЭјеОЕФНЛвзЯЕЭГЃЌР§ШчЬдБІЭјЃЌЕБЕъМвГіЪлвЛМўЩЬЦЗЃЌПтДцМѕвЛЃЌПЭЛЇЭЫЛѕЃЌПтДцМгвЛЃЌЕБПтДцЮЊСуЃЌЩЬЦЗЯТМмЃЌгаЮЪЬтЯпЯТЬжТлЁЃДЫРрНЛвзЯЕЭГЬсЙЉМђЕЅПьЫйЕФМЦЫуЁЃвђЮЊВЛЭЌЦЗХЦЩЬЦЗЕФЯњЪлБЫДЫжЎМфУЛгаЙиСЊадЃЌВЛЛсвђЮЊФГМўЦЗХЦЩЬЦЗЕФГіЪлЙиСЊЕНЦфЫћЦЗХЦЩЬЦЗЕФПтДцСПЃЌЫќУЧЕФЩЬЦЗПтДцЪЧЪєгкЁАОВЬЌПтДцЁБ

ЁЁЁЁдйРДПДПД12306ЃК12306ЛЅСЊЭјЪлЦБЯЕЭГЪЧвЕЮёТпМКмИДдгЕФЯЕЭГЃЌШчЙћНЋУПеХПЩГіЪлЕФЛ№ГЕЦБЕБГЩвЛМўЩЬЦЗРДПДЃЌУПеХЦБЕФЯњЪлЖМЛсЙиСЊЕНећЬѕТЗЯпУПИіеОЕуПЩЯњЪлЕФгрЦБСП,гааЉеОЕуЕФгрЦБСПЛсВњЩњБфЛЏЃЌ гааЉеОЕугрЦБСПВЛЛсгаБфЛЏЁЃ

ЁЁЁЁгЩСэЭтвЛИіНЧЖШРДПДЃЌЕБЯњЪлвЛеХЦБЃЌ ИФЧЉЃЌЛђЭЫЦБЪБЃЌећЬѕТЗЯпУПИіеОЕуЕФгрЦБСПЖМашвЊжиаТМЦЫуЃЌвВОЭЪЧЫЕУПИіеОЕуЕФгрЦБПтДцЪЧИіЁАЖЏЬЌБфЛЏПтДцЁБЕФИХФюЁЃеОЕугыеОЕужЎМфЕФгрЦБПтДцгаОоДѓЕФЙиСЊадЃЌДЫЁАЖЏЬЌПтДцЁБИХФюЕФвЕЮёТпМЪЧ12306гыЕчЩЬЭјеОзюДѓЕФВювьЁЃ12306ЕФЩшМЦжиЕуВЛЕЋвЊОпгаДѓаЭЕчЩЬЭјеОЫљОпБИЕФЬиадЭт (вЊЬсЙЉПьЫйЯьгІЪБМфЃЌИпПЩгУад(ШнджКЭБИЗн)КЭЯЕЭГЕФРЉеЙад)ЃЌЛЙашвЊгаЧПДѓЕФCPUМЦЫузЪдДРДжЇГХЁЃ

ЁЁЁЁМјгк12306УЛгаЭМЦЌЁЂЪгЦЕЕШгАЯьДјПэЕФФкШнЃЌжївЊУЌЖмЪЧЪ§ОнПтЕФИпВЂЗЂСПЃЌВЩгУФкДцЪ§ОнПтЪЧе§ШЗЕФНтОіЫМТЗЁЃВЮПМФПЧАЙњФкЭтГЩЪьЕчЩЬЭјеООбщ,Р§ШчЙњФкЕФЬдБІ,АйЖШ,ЙњЭтЕФЙШИшЕШетРргазХКЃСПгУЛЇЗУЮЪЕФЭјеО,ЖМВЛдМЖјЭЌЕФВЩгУЗжВМЪНЕФЪ§ОнДІРэЦНЬЈ,ЖјGemfireе§ЪЧвЛИіЛљгкФкДцЕФЗжВМЪНЪ§ОнПт,ВЂЧвгЕгаДѓСПЕФГЩЙІАИР§,ЗЧГЃЪЪКЯРДНтОі12306ЕФЮЪЬтЁЃЮвУЧФмПДЕНЃЌетСНФъЙигк12306ЭјЛ№ГЕгрЦБСПВЛзМЕФБЇдЙШЗЪЕМѕЩйСЫЁЃ

Ёј12306ГЩГЄРњГЬЃК12306ЭјеО3ФъЪБМфЗУЮЪСПДг10вкPVБЉеЧЕН100вкPVЃЌЪлЦБСПДг100ЭђдіМгЕН500ЭђЃЌГіЦБДІРэФмСІ200еХ/УыдіМгЕН1000еХ/УыЁЃ

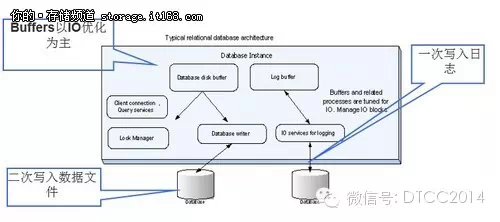

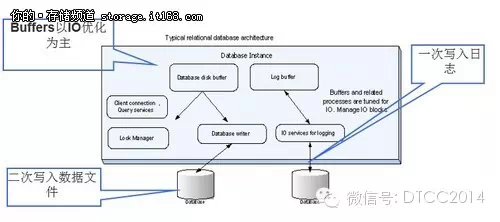

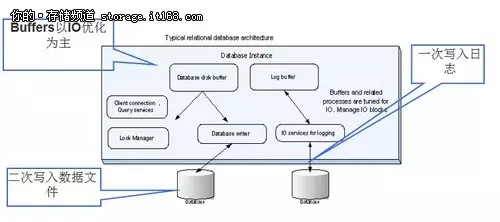

ЁЁЁЁбюаёОћБэЪОЃЌеыЖдгЩКЃСПгУЛЇЗУЮЪДјРДЕФИпВЂЗЂЬєеНЃЌGemfireБОЩэОЭЪЧЛљгкФкДцЕФММЪѕМмЙЙ,ЖдгкВЂЗЂЗУЮЪгаЬьШЛЕФIOгХЪЦЁЃЭЌЪБGemfireЪЧвЛИіЗжВМЪНЪ§ОнПт,ПЩвдНЋЪ§ОнЗУЮЪЕФЧыЧѓЗжЩЂЕНМЏШКжа,гааЇНЕЕЭСЫЕЅИіЗўЮёЦїЕФИККЩЁЃЖЏЬЌЕФЗжВМЪНМмЙЙ,ПЩвддкдЫааЪБдіМгЗўЮёНкЕу,ДгЖјЛёЕУИќИпЕФВЂЗЂадФмЁЃ

ЁЁЁЁИпСїСПЗНУцЃЌжївЊЩцМАЕЭбгГйЕФгрЦБВщбЏЁЃGemfireжЇГжРрMap-ReduceВЂааДІРэЃЌФмЙЛАДГЕДЮНЋгрЦБЁЂЙВгУЖЈвхЕШЪ§ОнВ№ЗжГЩЖрИіЖРСЂЕФМЦЫуЕЅдЊ,ЖдгрЦБВщбЏжазюКФЪБЕФЙВ гУЖЈвхВПЗжзідЄЯШДІРэ,ЩњГЩВщбЏЛКДцЁЃЕБгрЦБЪ§ОнЗЂЩњБфЛЏЪБ,ЯЕЭГЛсЖЏЬЌИќаТВщбЏЛКДцЁЃгаСЫдЄДІРэМАЪ§ОнЭЌВНЙ§ГЬЮЌЛЄЕФЖЏЬЌВщбЏЛКДц,ЕЅДЮВщбЏПЩвдПижЦдк10ms-300msжЎМф, ЭЌЪБ10ЗжжгЕФЙЬгабгГйвВВЛДцдкСЫЁЃ

ЁЁЁЁ12306Дг2012Фъ3дТПЊЪМИФдьЃЌАбдЯШВЩгУЕФUnixаЁаЭЛњМмЙЙЃЌЭЈЙ§GemFireЕФЗжВМЪНФкДцМЦЫуЦНЬЈИФдьГЩLinux/X86ЗўЮёЦїМЏШКМмЙЙЃЌДгЖјЬсЩ§СЫВщбЏгрЦБЕФЫйЖШЁЃИљОнЯЕЭГдЫааЪ§ОнМЧТМЃЌММЪѕИФдьжЎКѓЃЌдкжЛВЩгУ10МИЬЈX86ЗўЮёЦїЪЕЯжСЫвдЧАЪ§ЪЎЬЈаЁаЭЛњЕФгрЦБМЦЫуКЭВщбЏФмСІЃЌЕЅДЮВщбЏЕФзюГЄЪБМфДгжЎЧАЕФ15УызѓгвЯТНЕЕН0.2УывдЯТЃЌЫѕЖЬСЫ75БЖвдЩЯЁЃ2012ФъДКдЫЕФМЋЖЫИпСїСПВЂЗЂЧщПіЯТЃЌжЇГжУПУыЩЯЭђДЮЕФВЂЗЂВщбЏЃЌИпЗхЦкМфДяЕН2.6ЭђQPSЭЬЭТСПЃЌећИіЯЕЭГаЇТЪЯджјЬсИпЁЃ

ЁЁЁЁЖЉЕЅВщбЏЯЕЭГИФдьЃЌдкИФдьжЎЧАЕФЯЕЭГдЫааФЃЪНЯТЃЌУПУыжЛФмжЇГж300-400ИіQPSЕФЭЬЭТСПЃЌИпСїСПЕФВЂЗЂВщбЏжЛФмЭЈЙ§ЗжПтРДЪЕЯжЁЃИФдьжЎКѓЃЌПЩвдЪЕЯжИпДяЩЯЭђИіQPSЕФЭЬЭТСПЃЌЖјЧвВщбЏЫйЖШПЩвдБЃеЯдк20КСУызѓгвЁЃаТЕФММЪѕМмЙЙПЩвдАДашЕЏадЖЏЬЌРЉеЙЃЌВЂЗЂСПдіМгЪБЃЌЛЙПЩвдЭЈЙ§ЖЏЬЌдіМгX86ЗўЮёЦїРДгІЖдЃЌБЃГжКСУыМЖЕФЯьгІЪБМфЁЃ

ЁЁЁЁдквдЭљЕФДКдЫЦкМфЃЌ12306ЪлЦБЯЕЭГВПЪ№GemfireМЏШКдк2ИіЪ§ОнжааФЃЌЬсЙЉЗўЮёЁЃдк2015ФъДКдЫЙКЦБИпЗхжЎЧАЃЌПМТЧЕНГЌДѓВЂЗЂЛсдьГЩЭјТчСїСПДѓвдМАзшШћЕФЮЪЬтЃЌНёФъЬиБ№дкАЂРядЦНЈСЂвЛИіЪ§ОнжааФЃЌгЩАЂРядЦЬсЙЉЁАащФтЛњЁБЕФзтСоЗўЮёЃЌНЋЛљгкGemfireЪЕЯжгрЦБВщбЏЙІФмЕФЯЕЭГвдМАWebЗўЮёВПЪ№дкетаЉащФтЛњЩЯЃЌвдЗжСїЁАгрЦБВщбЏЁБЧыЧѓЃЌНтОівђЮЊИпЗхЦкГЌИпВЂЗЂдьГЩЕФЭјТчзшШћЮЪЬтЃЌвдНјвЛВНЬсИпЗўЮёЦЗжЪЁЃЮЊДЫЃЌ12306дк2014ФъЯТАыФъдкАЂРядЦзіСЫаЁЙцФЃЕФВПЪ№КЭЕїЪдЁЃ2015ФъДКдЫЙКЦБИпЗхЦкЕФ12306ИпаЇЦНЮШдЫааЃЌвВбщжЄСЫЛьКЯМмЙЙЕФПЩааадЁЃ

ЁЁЁЁзїЮЊЙњФкЪ§ОнПтгыДѓЪ§ОнСьгђзюДѓЙцФЃЕФММЪѕЪЂбчЃЌРДздBATЁЂ360ЁЂОЉЖЋЁЂУРЭХЁЂ58ЭЌГЧЁЂEbayЁЂаТРЫЁЂЭјвзЁЂЫбКќЁЂвзГЕЭјЁЂШЅФФЖљЭјЁЂаЏГЬЭјЕШЛЅСЊЭјЦѓвЕЃЌЮЂШэЁЂФЯДѓЭЈгУЕШЪ§ОнПтГЇЩЬЁЂвдМАББОЉДѓбЇЕШбЇЪѕЛњЙЙЕШАйгрУћЖЅМтзЈМвЯжЩэбнНВЃЌЮЊДѓМвЗюЯзСЫМЋЮЊБІЙѓЕФИЩЛѕбнНВЁЃ

ЁЁЁЁдк2015жаЙњЪ§ОнПтММЪѕДѓЛсЩЯЃЌЯжГЁеЙЬЈШЫдББЌТњЃЌРДздЮЂШэЁЂАйЖШЁЂаЧЛЗПЦММЁЂБІДцПЦММЁЂдЦКЭЖїФЋЁЂЬ§дЦЁЂгРКщBIЁЂGreeliantЁЂAction TechnologyЁЂОоЩМЪ§ОнПтЁЂСЊЯыЁЂЛлПЦЁЂдЦжЧЛлЕШГЇЩЬЧПСІМгУЫЃЌДѓЛсЯжГЁгаЛЅСЊЭјМвЭЅЛњЦїШЫеЙЬЈЃЌЯжГЁВЮЛсЕФХѓгбгаЛњЛсгыЛњЦїШЫЛЅЖЏЃЌЭЌЪБДѓЛсЯжГЁЛЙАВХХСЫЬюЕїВщгЎШЁНБЦЗЛЅЖЏЛЗНкЁЃИќЖрОЊЯВЃЌОЁдк2015жаЙњЪ§ОнПтММЪѕДѓЛсЯжГЁЁЃ

12306.cnЮовЩЪЧШЋЧђзюЗБУІЕФЭјеОЃЌУПЕНЬиЪтНкШеЃЌетИіЪРНчЩЯЙцФЃзюДѓЕФЪЕЪБНЛвзЯЕЭГЖМвЊУцСйОоДѓПМбщЁЃ2012ФъГѕЕФДКдЫИпЗхЦкМфЃЌУПЬьга2000ЭђШЫЗУЮЪИУЭјеОЃЌШеЕуЛїСПзюИпДяЕН14вкЃЌДѓСПЭЌЪБгПШыЕФЭјТчЗУЮЪдьГЩ12306МИНќЬБЛОЁЃ

ЁЁЁЁЮЊСЫИФБфЁАЗъНкБиЬБЁБЕФЯжзДЃЌЬњТЗзмЙЋЫОДг2012Фъ6дТПЊЪМбЁдёPivotal GemFireЗжВМЪНФкДцМЦЫуЦНЬЈЖд12306НјааИФдьЁЃШчНё3ФъЙ§ШЅЃЌ2015ФъЬњТЗПЭЦБЕФДКдЫдчвбНсЪјЃЌВЛФбЗЂЯжЃЌгыЭљФъЯрБШНёФъДѓМвЖд12306ЭТВлЕФЛЈБпаТЮХЩйСЫКмЖрЁЃ

ЁЁЁЁдкЕкСљНьжаЙњЪ§ОнПтММЪѕДѓЛс(DTCC 2015)ЕФЁАФкДцЪ§ОнПтзЈГЁЁБжаЃЌжаЙњПЦбЇдКздЖЏЛЏбаОПЫљДѓЪ§ОнгІгУВПИпМЖбаОПдБбюаёОћЮЊЮвУЧЯъОЁНтЖССЫGemFireЪЧШчКЮАяжњ12306АкЭбЁАБЅЪмкИВЁЁБЕФУќдЫЁЃ

ЁЁЁЁ

ЁЁЁЁЁјжаЙњПЦбЇдКздЖЏЛЏбаОПЫљДѓЪ§ОнгІгУВПИпМЖбаОПдБбюаёОћ

ЁЁЁЁЛиЙЫGemFireЕФЧАЪРНёЩњ

ЁЁЁЁ1982Фъ

ЁЁЁЁGemStone SystemsГЩСЂгкУРЙњЖэРеИджнЮїББВПГЧЪаБШИЅЖйЪаЁЃGemStoneЪЧСьЯШЕФЗжВМЪНЪ§ОнЙмРэММЪѕШэМўЙЋЫОЃЌдкДЫЗНУцгазХКёжиЕФРњЪЗЁЃзюГѕЪЙгУSmalltalkгябдПЊЗЂГіСЫЕквЛДњУцЯђЖдЯѓЕФЪ§ОнПтЁЃВЂГЩЮЊSmalltalkжДааЮЏдБЛсГЩдБЁЃ

ЁЁЁЁ1986Фъ

ЁЁЁЁЕквЛДњВњЦЗGemstone/S е§ЪНУцЪРЃЌЪмЕНН№ШкЪаГЁЕФЙуЗКЛЖгЁЃ

ЁЁЁЁ90ФъДњжаКѓЦк

ЁЁЁЁЫцзХJavaгябдЕФЙуЗКгІгУЃЌGemStoneгыSunЙЋЫОКЯзїЃЌВЮгыЕНJEEЕФЙцЗЖжЦЖЈ(JCache -JSR107)ЃЌВЂТНајИќаТгыJEEЦНЬЈЯрНсКЯЕФВњЦЗЁЃGemStoneПЊЗЂГіСЫGemFireЃЌГЩЮЊвЕНчЕквЛИіТњзуJ2EEБъзМЕФжаМфМўЁЃGemFireгЕгаШЋаТЕФгІгУПђМмЃЌМцШнJava, C++, C#ЁЃЖјGemFireдкCEP(complex event processing)ЃЌEvent Stream ProcessingЃЌData VirtualizationЃЌ Distributed CachingМИИіЗНУцгазХОйзуЧсжиЕФЕиЮЛЁЃ

ЁЁЁЁ2008ФъГѕ

ЁЁЁЁН№ШкЮЃЛњКѓЃЌН№ШкМрЙмЗЈЙцDodd-FrankЁЂBasel3ЕШТНајГіЬЈЃЌИїДѓЭЖзЪвјааЮЊСЫМѕЩйЯЕЭГЗчЯеКЭдіМгЭИУїЖШЃЌМгЧПСЫН№ШкбмЩњЦЗНЛвзЦНЬЈЕФЭЖзЪЙцФЃЃЌGemfireЛїАмOracleЕШРЯХЦГЇЩЬЃЌѕвЩэЮЊЛЊЖћНжЕквЛДѓЗжВМЪНЪ§ОнДІРэЦНЬЈШэМўЁЃ

ЁЁЁЁ2010Фъ5дТ

ЁЁЁЁVMwareЪеЙКСЫРЯХЦГЇЩЬGemstoneЃЌВЂШыSpringSourceВПУХЁЃ

ЁЁЁЁ12306ЕФЁАЫЋИпЬєеНЁБ

ЁЁЁЁОнбюаёОћНщЩмЃЌдк2015ФъДКдЫИпЗхШеЃЌ12306ЕФPVжЕЪЧ297вкЃЌСїСПНЯЦНЪБдіМг1000БЖЁЃ

ЁЁЁЁ12306зїЮЊвЛИіУцЯђЙЋжкЕФЯЕЭГ,ЛЅСЊЭјЪлЦБЯЕЭГОпБИЫљгаДѓаЭЛЅСЊЭјЯЕЭГЕФЬиад:ЁАИпВЂЗЂЁБ, ЁАИпСїСПЁБЁЃгШЦфЪЧдкЮвЙњЕФИїИіНкМйШе,ЯЕЭГЕФЗУЮЪСПЛсМЄді,ЕМжТећИіЯЕЭГКѓЬЈбЙСІЙ§Дѓ,ЯьгІБфТ§ЁЃ

ЁЁЁЁ

ЁЁЁЁЁјДЋЭГЙиЯЕаЭЪ§ОнПтЫљУцСйЕФЬєеН

ЁЁЁЁгаЭјгбЕїйЉЫЕЃЌ12306ЦфЪЕвВЪЧвЛИіЕчЩЬЦНЬЈЃЌЖјЧвЪЧШЋЧђзюИДдгЁЂЙцФЃзюДѓЕФЕчЩЬЦНЬЈЁЃЕЋЪЕМЪЩЯЃЌ12306БГКѓЫљвўВиЕФвЕЮёТпМЗЧГЃИДдгЃЌдЖдЖГЌЙ§вЛАуЕФЕчЩЬЦНЬЈЁЃ

ЁЁЁЁЖдгкЕчзгЩЬЮёЭјеОЕФНЛвзЯЕЭГЃЌР§ШчЬдБІЭјЃЌЕБЕъМвГіЪлвЛМўЩЬЦЗЃЌПтДцМѕвЛЃЌПЭЛЇЭЫЛѕЃЌПтДцМгвЛЃЌЕБПтДцЮЊСуЃЌЩЬЦЗЯТМмЃЌгаЮЪЬтЯпЯТЬжТлЁЃДЫРрНЛвзЯЕЭГЬсЙЉМђЕЅПьЫйЕФМЦЫуЁЃвђЮЊВЛЭЌЦЗХЦЩЬЦЗЕФЯњЪлБЫДЫжЎМфУЛгаЙиСЊадЃЌВЛЛсвђЮЊФГМўЦЗХЦЩЬЦЗЕФГіЪлЙиСЊЕНЦфЫћЦЗХЦЩЬЦЗЕФПтДцСПЃЌЫќУЧЕФЩЬЦЗПтДцЪЧЪєгкЁАОВЬЌПтДцЁБ

ЁЁЁЁдйРДПДПД12306ЃК12306ЛЅСЊЭјЪлЦБЯЕЭГЪЧвЕЮёТпМКмИДдгЕФЯЕЭГЃЌШчЙћНЋУПеХПЩГіЪлЕФЛ№ГЕЦБЕБГЩвЛМўЩЬЦЗРДПДЃЌУПеХЦБЕФЯњЪлЖМЛсЙиСЊЕНећЬѕТЗЯпУПИіеОЕуПЩЯњЪлЕФгрЦБСП,гааЉеОЕуЕФгрЦБСПЛсВњЩњБфЛЏЃЌ гааЉеОЕугрЦБСПВЛЛсгаБфЛЏЁЃ

ЁЁЁЁгЩСэЭтвЛИіНЧЖШРДПДЃЌЕБЯњЪлвЛеХЦБЃЌ ИФЧЉЃЌЛђЭЫЦБЪБЃЌећЬѕТЗЯпУПИіеОЕуЕФгрЦБСПЖМашвЊжиаТМЦЫуЃЌвВОЭЪЧЫЕУПИіеОЕуЕФгрЦБПтДцЪЧИіЁАЖЏЬЌБфЛЏПтДцЁБЕФИХФюЁЃеОЕугыеОЕужЎМфЕФгрЦБПтДцгаОоДѓЕФЙиСЊадЃЌДЫЁАЖЏЬЌПтДцЁБИХФюЕФвЕЮёТпМЪЧ12306гыЕчЩЬЭјеОзюДѓЕФВювьЁЃ12306ЕФЩшМЦжиЕуВЛЕЋвЊОпгаДѓаЭЕчЩЬЭјеОЫљОпБИЕФЬиадЭт (вЊЬсЙЉПьЫйЯьгІЪБМфЃЌИпПЩгУад(ШнджКЭБИЗн)КЭЯЕЭГЕФРЉеЙад)ЃЌЛЙашвЊгаЧПДѓЕФCPUМЦЫузЪдДРДжЇГХЁЃ

ЁЁЁЁМјгк12306УЛгаЭМЦЌЁЂЪгЦЕЕШгАЯьДјПэЕФФкШнЃЌжївЊУЌЖмЪЧЪ§ОнПтЕФИпВЂЗЂСПЃЌВЩгУФкДцЪ§ОнПтЪЧе§ШЗЕФНтОіЫМТЗЁЃВЮПМФПЧАЙњФкЭтГЩЪьЕчЩЬЭјеООбщ,Р§ШчЙњФкЕФЬдБІ,АйЖШ,ЙњЭтЕФЙШИшЕШетРргазХКЃСПгУЛЇЗУЮЪЕФЭјеО,ЖМВЛдМЖјЭЌЕФВЩгУЗжВМЪНЕФЪ§ОнДІРэЦНЬЈ,ЖјGemfireе§ЪЧвЛИіЛљгкФкДцЕФЗжВМЪНЪ§ОнПт,ВЂЧвгЕгаДѓСПЕФГЩЙІАИР§,ЗЧГЃЪЪКЯРДНтОі12306ЕФЮЪЬтЁЃЮвУЧФмПДЕНЃЌетСНФъЙигк12306ЭјЛ№ГЕгрЦБСПВЛзМЕФБЇдЙШЗЪЕМѕЩйСЫЁЃ

Ёј12306ГЩГЄРњГЬЃК12306ЭјеО3ФъЪБМфЗУЮЪСПДг10вкPVБЉеЧЕН100вкPVЃЌЪлЦБСПДг100ЭђдіМгЕН500ЭђЃЌГіЦБДІРэФмСІ200еХ/УыдіМгЕН1000еХ/УыЁЃ

ЁЁЁЁбюаёОћБэЪОЃЌеыЖдгЩКЃСПгУЛЇЗУЮЪДјРДЕФИпВЂЗЂЬєеНЃЌGemfireБОЩэОЭЪЧЛљгкФкДцЕФММЪѕМмЙЙ,ЖдгкВЂЗЂЗУЮЪгаЬьШЛЕФIOгХЪЦЁЃЭЌЪБGemfireЪЧвЛИіЗжВМЪНЪ§ОнПт,ПЩвдНЋЪ§ОнЗУЮЪЕФЧыЧѓЗжЩЂЕНМЏШКжа,гааЇНЕЕЭСЫЕЅИіЗўЮёЦїЕФИККЩЁЃЖЏЬЌЕФЗжВМЪНМмЙЙ,ПЩвддкдЫааЪБдіМгЗўЮёНкЕу,ДгЖјЛёЕУИќИпЕФВЂЗЂадФмЁЃ

ЁЁЁЁИпСїСПЗНУцЃЌжївЊЩцМАЕЭбгГйЕФгрЦБВщбЏЁЃGemfireжЇГжРрMap-ReduceВЂааДІРэЃЌФмЙЛАДГЕДЮНЋгрЦБЁЂЙВгУЖЈвхЕШЪ§ОнВ№ЗжГЩЖрИіЖРСЂЕФМЦЫуЕЅдЊ,ЖдгрЦБВщбЏжазюКФЪБЕФЙВ гУЖЈвхВПЗжзідЄЯШДІРэ,ЩњГЩВщбЏЛКДцЁЃЕБгрЦБЪ§ОнЗЂЩњБфЛЏЪБ,ЯЕЭГЛсЖЏЬЌИќаТВщбЏЛКДцЁЃгаСЫдЄДІРэМАЪ§ОнЭЌВНЙ§ГЬЮЌЛЄЕФЖЏЬЌВщбЏЛКДц,ЕЅДЮВщбЏПЩвдПижЦдк10ms-300msжЎМф, ЭЌЪБ10ЗжжгЕФЙЬгабгГйвВВЛДцдкСЫЁЃ

ЁЁЁЁ12306Дг2012Фъ3дТПЊЪМИФдьЃЌАбдЯШВЩгУЕФUnixаЁаЭЛњМмЙЙЃЌЭЈЙ§GemFireЕФЗжВМЪНФкДцМЦЫуЦНЬЈИФдьГЩLinux/X86ЗўЮёЦїМЏШКМмЙЙЃЌДгЖјЬсЩ§СЫВщбЏгрЦБЕФЫйЖШЁЃИљОнЯЕЭГдЫааЪ§ОнМЧТМЃЌММЪѕИФдьжЎКѓЃЌдкжЛВЩгУ10МИЬЈX86ЗўЮёЦїЪЕЯжСЫвдЧАЪ§ЪЎЬЈаЁаЭЛњЕФгрЦБМЦЫуКЭВщбЏФмСІЃЌЕЅДЮВщбЏЕФзюГЄЪБМфДгжЎЧАЕФ15УызѓгвЯТНЕЕН0.2УывдЯТЃЌЫѕЖЬСЫ75БЖвдЩЯЁЃ2012ФъДКдЫЕФМЋЖЫИпСїСПВЂЗЂЧщПіЯТЃЌжЇГжУПУыЩЯЭђДЮЕФВЂЗЂВщбЏЃЌИпЗхЦкМфДяЕН2.6ЭђQPSЭЬЭТСПЃЌећИіЯЕЭГаЇТЪЯджјЬсИпЁЃ

ЁЁЁЁЖЉЕЅВщбЏЯЕЭГИФдьЃЌдкИФдьжЎЧАЕФЯЕЭГдЫааФЃЪНЯТЃЌУПУыжЛФмжЇГж300-400ИіQPSЕФЭЬЭТСПЃЌИпСїСПЕФВЂЗЂВщбЏжЛФмЭЈЙ§ЗжПтРДЪЕЯжЁЃИФдьжЎКѓЃЌПЩвдЪЕЯжИпДяЩЯЭђИіQPSЕФЭЬЭТСПЃЌЖјЧвВщбЏЫйЖШПЩвдБЃеЯдк20КСУызѓгвЁЃаТЕФММЪѕМмЙЙПЩвдАДашЕЏадЖЏЬЌРЉеЙЃЌВЂЗЂСПдіМгЪБЃЌЛЙПЩвдЭЈЙ§ЖЏЬЌдіМгX86ЗўЮёЦїРДгІЖдЃЌБЃГжКСУыМЖЕФЯьгІЪБМфЁЃ

ЁЁЁЁдквдЭљЕФДКдЫЦкМфЃЌ12306ЪлЦБЯЕЭГВПЪ№GemfireМЏШКдк2ИіЪ§ОнжааФЃЌЬсЙЉЗўЮёЁЃдк2015ФъДКдЫЙКЦБИпЗхжЎЧАЃЌПМТЧЕНГЌДѓВЂЗЂЛсдьГЩЭјТчСїСПДѓвдМАзшШћЕФЮЪЬтЃЌНёФъЬиБ№дкАЂРядЦНЈСЂвЛИіЪ§ОнжааФЃЌгЩАЂРядЦЬсЙЉЁАащФтЛњЁБЕФзтСоЗўЮёЃЌНЋЛљгкGemfireЪЕЯжгрЦБВщбЏЙІФмЕФЯЕЭГвдМАWebЗўЮёВПЪ№дкетаЉащФтЛњЩЯЃЌвдЗжСїЁАгрЦБВщбЏЁБЧыЧѓЃЌНтОівђЮЊИпЗхЦкГЌИпВЂЗЂдьГЩЕФЭјТчзшШћЮЪЬтЃЌвдНјвЛВНЬсИпЗўЮёЦЗжЪЁЃЮЊДЫЃЌ12306дк2014ФъЯТАыФъдкАЂРядЦзіСЫаЁЙцФЃЕФВПЪ№КЭЕїЪдЁЃ2015ФъДКдЫЙКЦБИпЗхЦкЕФ12306ИпаЇЦНЮШдЫааЃЌвВбщжЄСЫЛьКЯМмЙЙЕФПЩааадЁЃ

ЁЁЁЁзїЮЊЙњФкЪ§ОнПтгыДѓЪ§ОнСьгђзюДѓЙцФЃЕФММЪѕЪЂбчЃЌРДздBATЁЂ360ЁЂОЉЖЋЁЂУРЭХЁЂ58ЭЌГЧЁЂEbayЁЂаТРЫЁЂЭјвзЁЂЫбКќЁЂвзГЕЭјЁЂШЅФФЖљЭјЁЂаЏГЬЭјЕШЛЅСЊЭјЦѓвЕЃЌЮЂШэЁЂФЯДѓЭЈгУЕШЪ§ОнПтГЇЩЬЁЂвдМАББОЉДѓбЇЕШбЇЪѕЛњЙЙЕШАйгрУћЖЅМтзЈМвЯжЩэбнНВЃЌЮЊДѓМвЗюЯзСЫМЋЮЊБІЙѓЕФИЩЛѕбнНВЁЃ

ЁЁЁЁдк2015жаЙњЪ§ОнПтММЪѕДѓЛсЩЯЃЌЯжГЁеЙЬЈШЫдББЌТњЃЌРДздЮЂШэЁЂАйЖШЁЂаЧЛЗПЦММЁЂБІДцПЦММЁЂдЦКЭЖїФЋЁЂЬ§дЦЁЂгРКщBIЁЂGreeliantЁЂAction TechnologyЁЂОоЩМЪ§ОнПтЁЂСЊЯыЁЂЛлПЦЁЂдЦжЧЛлЕШГЇЩЬЧПСІМгУЫЃЌДѓЛсЯжГЁгаЛЅСЊЭјМвЭЅЛњЦїШЫеЙЬЈЃЌЯжГЁВЮЛсЕФХѓгбгаЛњЛсгыЛњЦїШЫЛЅЖЏЃЌЭЌЪБДѓЛсЯжГЁЛЙАВХХСЫЬюЕїВщгЎШЁНБЦЗЛЅЖЏЛЗНкЁЃИќЖрОЊЯВЃЌОЁдк2015жаЙњЪ§ОнПтММЪѕДѓЛсЯжГЁЁЃ

12306.cnЮовЩЪЧШЋЧђзюЗБУІЕФЭјеОЃЌУПЕНЬиЪтНкШеЃЌетИіЪРНчЩЯЙцФЃзюДѓЕФЪЕЪБНЛвзЯЕЭГЖМвЊУцСйОоДѓПМбщЁЃ2012ФъГѕЕФДКдЫИпЗхЦкМфЃЌУПЬьга2000ЭђШЫЗУЮЪИУЭјеОЃЌШеЕуЛїСПзюИпДяЕН14вкЃЌДѓСПЭЌЪБгПШыЕФЭјТчЗУЮЪдьГЩ12306МИНќЬБЛОЁЃ

ЁЁЁЁЮЊСЫИФБфЁАЗъНкБиЬБЁБЕФЯжзДЃЌЬњТЗзмЙЋЫОДг2012Фъ6дТПЊЪМбЁдёPivotal GemFireЗжВМЪНФкДцМЦЫуЦНЬЈЖд12306НјааИФдьЁЃШчНё3ФъЙ§ШЅЃЌ2015ФъЬњТЗПЭЦБЕФДКдЫдчвбНсЪјЃЌВЛФбЗЂЯжЃЌгыЭљФъЯрБШНёФъДѓМвЖд12306ЭТВлЕФЛЈБпаТЮХЩйСЫКмЖрЁЃ

ЁЁЁЁдкЕкСљНьжаЙњЪ§ОнПтММЪѕДѓЛс(DTCC 2015)ЕФЁАФкДцЪ§ОнПтзЈГЁЁБжаЃЌжаЙњПЦбЇдКздЖЏЛЏбаОПЫљДѓЪ§ОнгІгУВПИпМЖбаОПдБбюаёОћЮЊЮвУЧЯъОЁНтЖССЫGemFireЪЧШчКЮАяжњ12306АкЭбЁАБЅЪмкИВЁЁБЕФУќдЫЁЃ

ЁЁЁЁ

ЁЁЁЁЁјжаЙњПЦбЇдКздЖЏЛЏбаОПЫљДѓЪ§ОнгІгУВПИпМЖбаОПдБбюаёОћ

ЁЁЁЁЛиЙЫGemFireЕФЧАЪРНёЩњ

ЁЁЁЁ1982Фъ

ЁЁЁЁGemStone SystemsГЩСЂгкУРЙњЖэРеИджнЮїББВПГЧЪаБШИЅЖйЪаЁЃGemStoneЪЧСьЯШЕФЗжВМЪНЪ§ОнЙмРэММЪѕШэМўЙЋЫОЃЌдкДЫЗНУцгазХКёжиЕФРњЪЗЁЃзюГѕЪЙгУSmalltalkгябдПЊЗЂГіСЫЕквЛДњУцЯђЖдЯѓЕФЪ§ОнПтЁЃВЂГЩЮЊSmalltalkжДааЮЏдБЛсГЩдБЁЃ

ЁЁЁЁ1986Фъ

ЁЁЁЁЕквЛДњВњЦЗGemstone/S е§ЪНУцЪРЃЌЪмЕНН№ШкЪаГЁЕФЙуЗКЛЖгЁЃ

ЁЁЁЁ90ФъДњжаКѓЦк

ЁЁЁЁЫцзХJavaгябдЕФЙуЗКгІгУЃЌGemStoneгыSunЙЋЫОКЯзїЃЌВЮгыЕНJEEЕФЙцЗЖжЦЖЈ(JCache -JSR107)ЃЌВЂТНајИќаТгыJEEЦНЬЈЯрНсКЯЕФВњЦЗЁЃGemStoneПЊЗЂГіСЫGemFireЃЌГЩЮЊвЕНчЕквЛИіТњзуJ2EEБъзМЕФжаМфМўЁЃGemFireгЕгаШЋаТЕФгІгУПђМмЃЌМцШнJava, C++, C#ЁЃЖјGemFireдкCEP(complex event processing)ЃЌEvent Stream ProcessingЃЌData VirtualizationЃЌ Distributed CachingМИИіЗНУцгазХОйзуЧсжиЕФЕиЮЛЁЃ

ЁЁЁЁ2008ФъГѕ

ЁЁЁЁН№ШкЮЃЛњКѓЃЌН№ШкМрЙмЗЈЙцDodd-FrankЁЂBasel3ЕШТНајГіЬЈЃЌИїДѓЭЖзЪвјааЮЊСЫМѕЩйЯЕЭГЗчЯеКЭдіМгЭИУїЖШЃЌМгЧПСЫН№ШкбмЩњЦЗНЛвзЦНЬЈЕФЭЖзЪЙцФЃЃЌGemfireЛїАмOracleЕШРЯХЦГЇЩЬЃЌѕвЩэЮЊЛЊЖћНжЕквЛДѓЗжВМЪНЪ§ОнДІРэЦНЬЈШэМўЁЃ

ЁЁЁЁ2010Фъ5дТ

ЁЁЁЁVMwareЪеЙКСЫРЯХЦГЇЩЬGemstoneЃЌВЂШыSpringSourceВПУХЁЃ

ЁЁЁЁ12306ЕФЁАЫЋИпЬєеНЁБ

ЁЁЁЁОнбюаёОћНщЩмЃЌдк2015ФъДКдЫИпЗхШеЃЌ12306ЕФPVжЕЪЧ297вкЃЌСїСПНЯЦНЪБдіМг1000БЖЁЃ

ЁЁЁЁ12306зїЮЊвЛИіУцЯђЙЋжкЕФЯЕЭГ,ЛЅСЊЭјЪлЦБЯЕЭГОпБИЫљгаДѓаЭЛЅСЊЭјЯЕЭГЕФЬиад:ЁАИпВЂЗЂЁБ, ЁАИпСїСПЁБЁЃгШЦфЪЧдкЮвЙњЕФИїИіНкМйШе,ЯЕЭГЕФЗУЮЪСПЛсМЄді,ЕМжТећИіЯЕЭГКѓЬЈбЙСІЙ§Дѓ,ЯьгІБфТ§ЁЃ

ЁЁЁЁ

ЁЁЁЁЁјДЋЭГЙиЯЕаЭЪ§ОнПтЫљУцСйЕФЬєеН

ЁЁЁЁгаЭјгбЕїйЉЫЕЃЌ12306ЦфЪЕвВЪЧвЛИіЕчЩЬЦНЬЈЃЌЖјЧвЪЧШЋЧђзюИДдгЁЂЙцФЃзюДѓЕФЕчЩЬЦНЬЈЁЃЕЋЪЕМЪЩЯЃЌ12306БГКѓЫљвўВиЕФвЕЮёТпМЗЧГЃИДдгЃЌдЖдЖГЌЙ§вЛАуЕФЕчЩЬЦНЬЈЁЃ

ЁЁЁЁЖдгкЕчзгЩЬЮёЭјеОЕФНЛвзЯЕЭГЃЌР§ШчЬдБІЭјЃЌЕБЕъМвГіЪлвЛМўЩЬЦЗЃЌПтДцМѕвЛЃЌПЭЛЇЭЫЛѕЃЌПтДцМгвЛЃЌЕБПтДцЮЊСуЃЌЩЬЦЗЯТМмЃЌгаЮЪЬтЯпЯТЬжТлЁЃДЫРрНЛвзЯЕЭГЬсЙЉМђЕЅПьЫйЕФМЦЫуЁЃвђЮЊВЛЭЌЦЗХЦЩЬЦЗЕФЯњЪлБЫДЫжЎМфУЛгаЙиСЊадЃЌВЛЛсвђЮЊФГМўЦЗХЦЩЬЦЗЕФГіЪлЙиСЊЕНЦфЫћЦЗХЦЩЬЦЗЕФПтДцСПЃЌЫќУЧЕФЩЬЦЗПтДцЪЧЪєгкЁАОВЬЌПтДцЁБ

ЁЁЁЁдйРДПДПД12306ЃК12306ЛЅСЊЭјЪлЦБЯЕЭГЪЧвЕЮёТпМКмИДдгЕФЯЕЭГЃЌШчЙћНЋУПеХПЩГіЪлЕФЛ№ГЕЦБЕБГЩвЛМўЩЬЦЗРДПДЃЌУПеХЦБЕФЯњЪлЖМЛсЙиСЊЕНећЬѕТЗЯпУПИіеОЕуПЩЯњЪлЕФгрЦБСП,гааЉеОЕуЕФгрЦБСПЛсВњЩњБфЛЏЃЌ гааЉеОЕугрЦБСПВЛЛсгаБфЛЏЁЃ

ЁЁЁЁгЩСэЭтвЛИіНЧЖШРДПДЃЌЕБЯњЪлвЛеХЦБЃЌ ИФЧЉЃЌЛђЭЫЦБЪБЃЌећЬѕТЗЯпУПИіеОЕуЕФгрЦБСПЖМашвЊжиаТМЦЫуЃЌвВОЭЪЧЫЕУПИіеОЕуЕФгрЦБПтДцЪЧИіЁАЖЏЬЌБфЛЏПтДцЁБЕФИХФюЁЃеОЕугыеОЕужЎМфЕФгрЦБПтДцгаОоДѓЕФЙиСЊадЃЌДЫЁАЖЏЬЌПтДцЁБИХФюЕФвЕЮёТпМЪЧ12306гыЕчЩЬЭјеОзюДѓЕФВювьЁЃ12306ЕФЩшМЦжиЕуВЛЕЋвЊОпгаДѓаЭЕчЩЬЭјеОЫљОпБИЕФЬиадЭт (вЊЬсЙЉПьЫйЯьгІЪБМфЃЌИпПЩгУад(ШнджКЭБИЗн)КЭЯЕЭГЕФРЉеЙад)ЃЌЛЙашвЊгаЧПДѓЕФCPUМЦЫузЪдДРДжЇГХЁЃ

ЁЁЁЁМјгк12306УЛгаЭМЦЌЁЂЪгЦЕЕШгАЯьДјПэЕФФкШнЃЌжївЊУЌЖмЪЧЪ§ОнПтЕФИпВЂЗЂСПЃЌВЩгУФкДцЪ§ОнПтЪЧе§ШЗЕФНтОіЫМТЗЁЃВЮПМФПЧАЙњФкЭтГЩЪьЕчЩЬЭјеООбщ,Р§ШчЙњФкЕФЬдБІ,АйЖШ,ЙњЭтЕФЙШИшЕШетРргазХКЃСПгУЛЇЗУЮЪЕФЭјеО,ЖМВЛдМЖјЭЌЕФВЩгУЗжВМЪНЕФЪ§ОнДІРэЦНЬЈ,ЖјGemfireе§ЪЧвЛИіЛљгкФкДцЕФЗжВМЪНЪ§ОнПт,ВЂЧвгЕгаДѓСПЕФГЩЙІАИР§,ЗЧГЃЪЪКЯРДНтОі12306ЕФЮЪЬтЁЃЮвУЧФмПДЕНЃЌетСНФъЙигк12306ЭјЛ№ГЕгрЦБСПВЛзМЕФБЇдЙШЗЪЕМѕЩйСЫЁЃ

Ёј12306ГЩГЄРњГЬЃК12306ЭјеО3ФъЪБМфЗУЮЪСПДг10вкPVБЉеЧЕН100вкPVЃЌЪлЦБСПДг100ЭђдіМгЕН500ЭђЃЌГіЦБДІРэФмСІ200еХ/УыдіМгЕН1000еХ/УыЁЃ

ЁЁЁЁбюаёОћБэЪОЃЌеыЖдгЩКЃСПгУЛЇЗУЮЪДјРДЕФИпВЂЗЂЬєеНЃЌGemfireБОЩэОЭЪЧЛљгкФкДцЕФММЪѕМмЙЙ,ЖдгкВЂЗЂЗУЮЪгаЬьШЛЕФIOгХЪЦЁЃЭЌЪБGemfireЪЧвЛИіЗжВМЪНЪ§ОнПт,ПЩвдНЋЪ§ОнЗУЮЪЕФЧыЧѓЗжЩЂЕНМЏШКжа,гааЇНЕЕЭСЫЕЅИіЗўЮёЦїЕФИККЩЁЃЖЏЬЌЕФЗжВМЪНМмЙЙ,ПЩвддкдЫааЪБдіМгЗўЮёНкЕу,ДгЖјЛёЕУИќИпЕФВЂЗЂадФмЁЃ

ЁЁЁЁИпСїСПЗНУцЃЌжївЊЩцМАЕЭбгГйЕФгрЦБВщбЏЁЃGemfireжЇГжРрMap-ReduceВЂааДІРэЃЌФмЙЛАДГЕДЮНЋгрЦБЁЂЙВгУЖЈвхЕШЪ§ОнВ№ЗжГЩЖрИіЖРСЂЕФМЦЫуЕЅдЊ,ЖдгрЦБВщбЏжазюКФЪБЕФЙВ гУЖЈвхВПЗжзідЄЯШДІРэ,ЩњГЩВщбЏЛКДцЁЃЕБгрЦБЪ§ОнЗЂЩњБфЛЏЪБ,ЯЕЭГЛсЖЏЬЌИќаТВщбЏЛКДцЁЃгаСЫдЄДІРэМАЪ§ОнЭЌВНЙ§ГЬЮЌЛЄЕФЖЏЬЌВщбЏЛКДц,ЕЅДЮВщбЏПЩвдПижЦдк10ms-300msжЎМф, ЭЌЪБ10ЗжжгЕФЙЬгабгГйвВВЛДцдкСЫЁЃ

ЁЁЁЁ12306Дг2012Фъ3дТПЊЪМИФдьЃЌАбдЯШВЩгУЕФUnixаЁаЭЛњМмЙЙЃЌЭЈЙ§GemFireЕФЗжВМЪНФкДцМЦЫуЦНЬЈИФдьГЩLinux/X86ЗўЮёЦїМЏШКМмЙЙЃЌДгЖјЬсЩ§СЫВщбЏгрЦБЕФЫйЖШЁЃИљОнЯЕЭГдЫааЪ§ОнМЧТМЃЌММЪѕИФдьжЎКѓЃЌдкжЛВЩгУ10МИЬЈX86ЗўЮёЦїЪЕЯжСЫвдЧАЪ§ЪЎЬЈаЁаЭЛњЕФгрЦБМЦЫуКЭВщбЏФмСІЃЌЕЅДЮВщбЏЕФзюГЄЪБМфДгжЎЧАЕФ15УызѓгвЯТНЕЕН0.2УывдЯТЃЌЫѕЖЬСЫ75БЖвдЩЯЁЃ2012ФъДКдЫЕФМЋЖЫИпСїСПВЂЗЂЧщПіЯТЃЌжЇГжУПУыЩЯЭђДЮЕФВЂЗЂВщбЏЃЌИпЗхЦкМфДяЕН2.6ЭђQPSЭЬЭТСПЃЌећИіЯЕЭГаЇТЪЯджјЬсИпЁЃ

ЁЁЁЁЖЉЕЅВщбЏЯЕЭГИФдьЃЌдкИФдьжЎЧАЕФЯЕЭГдЫааФЃЪНЯТЃЌУПУыжЛФмжЇГж300-400ИіQPSЕФЭЬЭТСПЃЌИпСїСПЕФВЂЗЂВщбЏжЛФмЭЈЙ§ЗжПтРДЪЕЯжЁЃИФдьжЎКѓЃЌПЩвдЪЕЯжИпДяЩЯЭђИіQPSЕФЭЬЭТСПЃЌЖјЧвВщбЏЫйЖШПЩвдБЃеЯдк20КСУызѓгвЁЃаТЕФММЪѕМмЙЙПЩвдАДашЕЏадЖЏЬЌРЉеЙЃЌВЂЗЂСПдіМгЪБЃЌЛЙПЩвдЭЈЙ§ЖЏЬЌдіМгX86ЗўЮёЦїРДгІЖдЃЌБЃГжКСУыМЖЕФЯьгІЪБМфЁЃ

ЁЁЁЁдквдЭљЕФДКдЫЦкМфЃЌ12306ЪлЦБЯЕЭГВПЪ№GemfireМЏШКдк2ИіЪ§ОнжааФЃЌЬсЙЉЗўЮёЁЃдк2015ФъДКдЫЙКЦБИпЗхжЎЧАЃЌПМТЧЕНГЌДѓВЂЗЂЛсдьГЩЭјТчСїСПДѓвдМАзшШћЕФЮЪЬтЃЌНёФъЬиБ№дкАЂРядЦНЈСЂвЛИіЪ§ОнжааФЃЌгЩАЂРядЦЬсЙЉЁАащФтЛњЁБЕФзтСоЗўЮёЃЌНЋЛљгкGemfireЪЕЯжгрЦБВщбЏЙІФмЕФЯЕЭГвдМАWebЗўЮёВПЪ№дкетаЉащФтЛњЩЯЃЌвдЗжСїЁАгрЦБВщбЏЁБЧыЧѓЃЌНтОівђЮЊИпЗхЦкГЌИпВЂЗЂдьГЩЕФЭјТчзшШћЮЪЬтЃЌвдНјвЛВНЬсИпЗўЮёЦЗжЪЁЃЮЊДЫЃЌ12306дк2014ФъЯТАыФъдкАЂРядЦзіСЫаЁЙцФЃЕФВПЪ№КЭЕїЪдЁЃ2015ФъДКдЫЙКЦБИпЗхЦкЕФ12306ИпаЇЦНЮШдЫааЃЌвВбщжЄСЫЛьКЯМмЙЙЕФПЩааадЁЃ

ЁЁЁЁзїЮЊЙњФкЪ§ОнПтгыДѓЪ§ОнСьгђзюДѓЙцФЃЕФММЪѕЪЂбчЃЌРДздBATЁЂ360ЁЂОЉЖЋЁЂУРЭХЁЂ58ЭЌГЧЁЂEbayЁЂаТРЫЁЂЭјвзЁЂЫбКќЁЂвзГЕЭјЁЂШЅФФЖљЭјЁЂаЏГЬЭјЕШЛЅСЊЭјЦѓвЕЃЌЮЂШэЁЂФЯДѓЭЈгУЕШЪ§ОнПтГЇЩЬЁЂвдМАББОЉДѓбЇЕШбЇЪѕЛњЙЙЕШАйгрУћЖЅМтзЈМвЯжЩэбнНВЃЌЮЊДѓМвЗюЯзСЫМЋЮЊБІЙѓЕФИЩЛѕбнНВЁЃ

ЁЁЁЁдк2015жаЙњЪ§ОнПтММЪѕДѓЛсЩЯЃЌЯжГЁеЙЬЈШЫдББЌТњЃЌРДздЮЂШэЁЂАйЖШЁЂаЧЛЗПЦММЁЂБІДцПЦММЁЂдЦКЭЖїФЋЁЂЬ§дЦЁЂгРКщBIЁЂGreeliantЁЂAction TechnologyЁЂОоЩМЪ§ОнПтЁЂСЊЯыЁЂЛлПЦЁЂдЦжЧЛлЕШГЇЩЬЧПСІМгУЫЃЌДѓЛсЯжГЁгаЛЅСЊЭјМвЭЅЛњЦїШЫеЙЬЈЃЌЯжГЁВЮЛсЕФХѓгбгаЛњЛсгыЛњЦїШЫЛЅЖЏЃЌЭЌЪБДѓЛсЯжГЁЛЙАВХХСЫЬюЕїВщгЎШЁНБЦЗЛЅЖЏЛЗНкЁЃИќЖрОЊЯВЃЌОЁдк2015жаЙњЪ§ОнПтММЪѕДѓЛсЯжГЁЁЃ