ΉΣ‘ΊΉ‘Ί≠ΦΪ –ΤΫΧ®Ής’ΏΊ≠―÷φ≠Κ§@÷ΣΚθά¥‘¥Ί≠https://zhuanlan.zhihu.com/p/285994980±ύΦ≠Ί≠ΦΪ –ΤΫΧ®A survey of GPU sharing for DLΒ±«ΑΜζΤς―ßœΑ―ΒΝΖ÷–Θ§ Ι”ΟGPUΧαΙ©ΥψΝΠ“―Ψ≠Ζ«≥ΘΤ’±ιΘ§Ε‘”ΎGPU-based AI systemΒΡ―–ΨΩ“≤»γΜπ»γί±ΓΘ‘Ύ’β–©―–ΨΩ÷–Θ§“‘ΧαΗΏΉ ‘¥άϊ”Ο¬ ΈΣ÷ς“ΣΡΩ±ξΒΡGPUΙ≤œμ(GPU sharing) «Β±œ¬―–ΨΩΒΡ»»Βψ÷°“ΜΓΘGPUΙ≤œμ…φΦΑΒΫΒΡΦΦ θΟφΫœΙψΘ§Αϋά®GPUΦήΙΙΘ®ΦΤΥψΘ§¥φ¥ΔΒ»Θ©Θ§CudaΘ§IOΘ®ΡΎ¥φΘ§œ‘¥φΘ©Θ§ΜζΤς―ßœΑΩρΦήΘ®TfΘ§PytorchΘ©Θ§Φ·»Κ&ΒςΕ»Θ§ML/DLΥψΖ®ΧΊ–‘Θ§Ά®–≈Θ®ΒΞΜζΡΎΚΆΕύΜζΦδΘ©Θ§ΡφœρΙΛ≥Χ»»ȧ «“ΜΗωΉ‘…œΕχœ¬ΒΡΙΛΉςΓΘ±ΨΤΣΈΡ’¬œΘΆϊΡήΧαΙ©“ΜΗωΕ‘GPUΙ≤œμΙΛΉςΒΡΖ÷œμΘ§œΘΆϊΡήΚΆœύΙΊΝλ”ρΒΡ―–ΨΩ’ΏΟ«Ι≤Ά§Χ÷¬έΓΘœό”Ύ± ’ΏΡήΝΠ”–œόΘ§Ω…ΡήΜα≥ωœ÷“Μ–©¥μ¬©Θ§œΘΆϊΡήΕύΕύ÷Η’ΐΘ§Η––ΜΓΘ

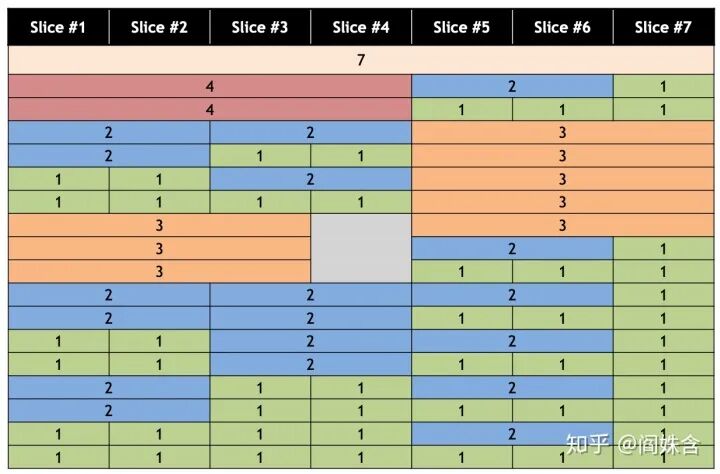

GPUΙ≤œμΘ§ «÷Η‘ΎΆ§“Μ’≈GPUΩ®…œΆ§ ±‘Υ––ΕύΗω»ΈΈώΓΘ”≈ Τ‘Ύ”ΎΘΚΘ®1Θ©Φ·»Κ÷–Ω…“‘‘Υ––ΗϋΕύ»ΈΈώΘ§Φθ…Ό«ά’ΦΓΘΘ®2Θ©Ή ‘¥άϊ”Ο¬ Θ®GPU/œ‘¥φ/e.t.c.Θ©ΧαΗΏΘΜGPUΙ≤œμΚσΘ§Ήήάϊ”Ο¬ Ϋ”Ϋϋ‘Υ––»ΈΈώάϊ”Ο¬ ÷°ΚΆΘ§Φθ…ΌΝΥΉ ‘¥άΥΖ―ΓΘΘ®3Θ©Ω…“‘‘ω«ΩΙΪΤΫ–‘Θ§“ρΈΣΕύΗω»ΈΈώΩ…“‘Ά§ ±ΩΣ Φœμ ήΉ ‘¥ΘΜ“≤Ω…“‘ΒΞΕά±Θ÷ΛΡ≥“ΜΗω»ΈΈώΒΡQoSΓΘΘ®4Θ©Φθ…Ό»ΈΈώ≈≈Ε” ±ΦδΓΘΘ®5Θ©Ήή»ΈΈώΫα χ ±Φδœ¬ΫΒΘΜΦΌ…ηΝΫΗω»ΈΈώΫα χ ±ΦδΖ÷±π «x,yΘ§Ά®ΙΐGPUΙ≤œμΘ§ΝΫΗω»ΈΈώ»Ϊ≤ΩΫα χΒΡ ±Φδ–Γ”Ύx+yΓΘ

œκ“Σ Βœ÷GPUΙ≤œμΘ§–η“ΣΆξ≥…ΒΡ÷ς“ΣΙΛΉς”–ΘΚΘ®1Θ©Ή ‘¥ΗτάκΘ§ «÷ΗΙ≤œμΉιΦΰ”–ΡήΝΠœό÷Τ»ΈΈώ’ΦΨίΥψΝΠΘ®œΏ≥Χ/SMΘ©ΦΑœ‘¥φΒΡ±»άΐΘ§ΗϋΫχ“Μ≤ΫΒΊΘ§Ω…“‘œό÷ΤΉήœΏ¥χΩμΓΘΘ®2Θ©≤Δ––ΡΘ ΫΘ§÷ς“Σ÷Η ±ΦδΤ§ΡΘ ΫΚΆMPSΡΘ ΫΓΘ

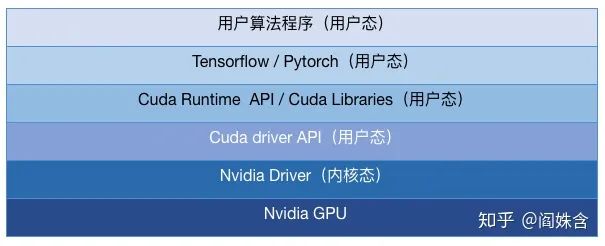

Ή ‘¥ΗτάκΉ ‘¥Ητάκ «÷ΗΙ≤œμΉιΦΰ”–ΡήΝΠœό÷Τ»ΈΈώ’ΦΨίΥψΝΠ/œ‘¥φΒΡ±»άΐΓΘœό÷ΤΒΡΖΫΖ®ΨΆ «ΫΌ≥÷Βς”ΟΓΘΆΦ“Μ «‘ΎNvidia GPU…œΘ§ΜζΤς―ßœΑΉ‘…œΕχœ¬ΒΡ ”ΆΦΓΘ”…”ΎCudaΚΆDriver≤ΜΩΣ‘¥Θ§“ρ¥ΥΉ ‘¥Ητάκ≤ψ“ΜΑψ¥Π‘Ύ”ΟΜßΧ§ΓΘ‘ΎΡΎΚΥΧ§ΉωΗτάκΒΡάßΡ―Ϋœ¥σΘ§ΒΪ“≤”–“Μ–©ΙΛΉςΓΘΥ≥¥χ“ΜΧαΘ§IntelΒΡDriver «ΩΣ‘¥ΒΡΘ§‘Ύdriver≤ψΒΡΙ≤œμΚΆ»»«®“ΤΖΫΟφ”–“Μ–©…œΚΘΫΜ¥σΚΆIntelΚœΉςΒΡΙΛΉςΓΘ

ΆΦ“Μ/ Ι”ΟNvidia GPUΜζΤς―ßœΑΉ‘…œΕχœ¬ ”ΆΦ

ΆΦ“Μ/ Ι”ΟNvidia GPUΜζΤς―ßœΑΉ‘…œΕχœ¬ ”ΆΦ

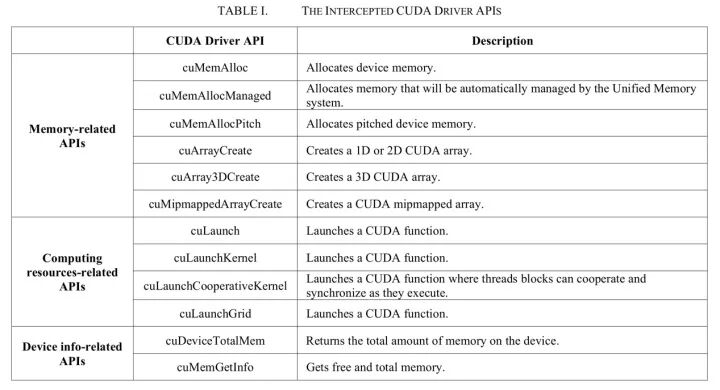

ά¥Ή‘ΧΎ―ΕΒΡGaia(ISPA'18)[1]Ι≤œμ≤ψ‘ΎCuda driver API÷°…œΘ§ΥϋΆ®ΙΐΫΌ≥÷Ε‘Cuda driver APIΒΡΒς”Οά¥ΉωΒΫΉ ‘¥ΗτάκΓΘΫΌ≥÷ΒΡΒς”Ο»γΆΦΕΰΥυ ΨΓΘ

ΨΏΧε Βœ÷ΖΫ Ϋ“≤ΫœΈΣ÷±Ϋ”Θ§‘ΎΒς”Οœύ”ΠAPI ±Φλ≤ιΘΚ

Θ®1Θ©Ε‘”Ύœ‘¥φΘ§“ΜΒ©ΗΟ»ΈΈώ…ξ«κœ‘¥φΚσ’Φ”ΟΒΡœ‘¥φ¥σ–Γ¥σ”Ύconfig÷–ΒΡ…η÷ΟΘ§ΨΆ±®¥μΓΘ

Θ®2Θ©Ε‘”ΎΦΤΥψΉ ‘¥Θ§¥φ‘Ύ”≤ΗτάκΚΆ»μΗτάκΝΫ÷÷ΖΫ ΫΘ§Ι≤Ά§Βψ «Β±»ΈΈώ Ι”ΟΒΡGPU SMάϊ”Ο¬ ≥§≥ωΉ ‘¥…œœόΘ§‘ρ‘ίΜΚœ¬ΖΔAPIΒς”ΟΓΘ≤ΜΆ§Βψ «»γΙϊ”–Ή ‘¥Ω’œ–Θ§»μΗτάκ‘ –μ»ΈΈώ≥§Ιΐ…η÷ΟΘ§Ε·Χ§ΦΤΥψΉ ‘¥…œœόΓΘΕχ”≤Ητάκ‘ρ≤Μ‘ –μ≥§≥ω…η÷ΟΝΩΓΘΗΟœνΡΩ¥ζ¬κΩΣ‘¥‘Ύ[2]ΓΘ Β≤βΦ¥ Ι÷Μ≈ή“ΜΗω»ΈΈώ“≤Μα”–Ϋœ¥σJCT”ΑœλΘ§Ω…Ρή «“ρΈΣΕ‘Ή ‘¥ΒΡœό÷ΤΦΑ ΊΜΛ≥Χ–ρΒΡΉ ‘¥’Φ”ΟΈ ΧβΓΘKubeShareΘ®HPDC '20Θ©[3]ΒΡ‘ΎΉ ‘¥ΗτάκΖΫΟφ“≤ «άύΥΤΒΡΖΫΑΗΓΘ

ΆΦΕΰ/ Gaiaœό÷ΤΒΡCUDA driver API

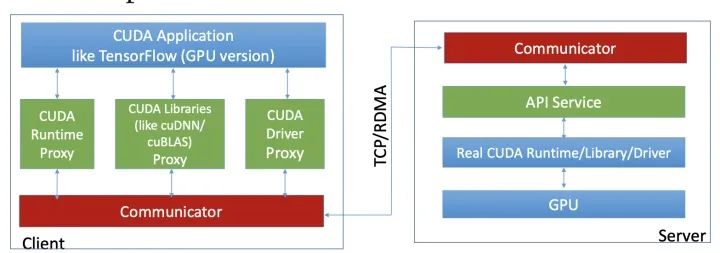

ΆΦΕΰ/ Gaiaœό÷ΤΒΡCUDA driver APIΖΔΝΥ44ΤΣ¬έΈΡΘ®ΫΊ÷Ι2020Ρξ3‘¬Θ©ΒΡrCuda[4]ΚΆGaia”–œύΥΤ÷°¥ΠΘ§ΥϊΟ«ΕΦ «‘ΎCuda driver API÷°…œΘ§Ά®ΙΐΫΌ≥÷Βς”Οά¥ΉωΉ ‘¥ΗτάκΓΘ≤ΜΆ§ΒΡ «Θ§rCuda≥ΐΝΥΉ ‘¥ΗτάκΘ§Ήν÷ς“ΣΒΡΡΩ±ξ «÷ß≥÷≥ΊΜ·ΓΘ≥ΊΜ·ΦρΒΞά¥Ϋ≤ΨΆ « Ι”Ο‘Ε≥ΧΖΟΈ ΒΡ–Έ Ϋ Ι”ΟGPUΉ ‘¥Θ§»ΈΈώ Ι”Ο±ΨΜζΒΡCPUΚΆΝμ“ΜΧ®ΜζΤςΒΡGPUΘ§ΝΫ’ΏΆ®ΙΐΆχ¬γΫχ––Ά®–≈ΓΘ“≤ «“ρΈΣ’βΗω‘≠“ρΘ§Ι≤œμΡΘΩι–η“ΣΫΪCPUΚΆGPUΒΡΒς”ΟΖ÷ΩΣΓΘ»ΜΕχ’ΐ≥Θ«ιΩωœ¬ΜλΚœ±ύ“κΒΡ≥Χ–ρΜα≤ε»κ“Μ–©ΟΜ”–ΩΣ‘¥ΒΡCuda APIΘ§“ρ¥Υ–η“Σ Ι”ΟΉς’ΏΧαΙ©ΒΡcudaΘ§Ζ÷±π±ύ“κ≥Χ–ρΒΡCPUΚΆGPU≤ΩΖ÷ΓΘΆΦ»ΐœ‘ ΨΝΥrCudaΒΡΦήΙΙΓΘ»γΙϊ Ι”ΟΗΟ≤ζΤΖΘ§”ΟΜß–η“Σ÷Ί–¬±ύ“κΘ§Ε‘”ΟΜß”–“ΜΕ®ΒΡ”ΑœλΓΘΗΟœνΡΩ¥ζ¬κ≤ΜΩΣ‘¥ΓΘΝμΆβvCUDAΘ®TC '12Θ©[5]ΚΆqCUDA(CloudCom '19)[18]“≤≤…”ΟΝΥΚΆrCudaœύΥΤΒΡΦΦ θΓΘ

ΆΦ»ΐ/rCudaΦήΙΙ

GPUShareΘ®IPDPSW' 16Θ©[6]“≤ «ΫΌ≥÷ΒΡΖΫ ΫΘ§ΒΪ≤ΜΆ§ΒΡ «,Υϋ≤…”Ο‘Λ≤β÷¥–– ±ΦδΒΡΖΫ Ϋά¥ Βœ÷ΦΤΥψΉ ‘¥ΒΡΙΪΤΫ–‘ΓΘΉς’Ώ»œΈΣ±»«–ΜΜ÷ήΤΎΜΙ–ΓΒΡΕΧkernel≤ΜΜα”ΑœλΙΪΤΫ Ι”ΟΘ§“ρ¥Υ÷Μœό÷ΤΝΥΫœ¥σΒΡkernelΓΘ

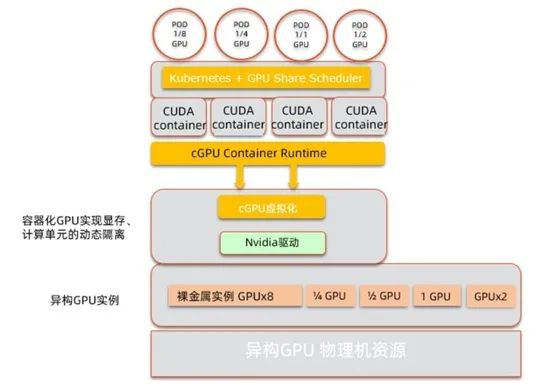

ά¥Ή‘ΑΔάοΒΡcGPU[7]Θ§ΤδΙ≤œμΡΘΩι‘ΎNvidia driver≤ψ÷°…œΘ§“≤ΨΆ «ΡΎΚΥΧ§ΓΘ”…”Ύ «‘ΎΙΪ”–‘Τ Ι”ΟΘ§œύΕ‘”Ύ”ΟΜßΧ§ΒΡΙ≤œμΜαΗϋΦ”Α≤»ΪΓΘΥϋ“≤ «Ά®ΙΐΫΌ≥÷Ε‘driverΒΡΒς”ΟΆξ≥…Ή ‘¥ΗτάκΒΡΘ§Ά®Ιΐ…η÷Ο»ΈΈώ’Φ”Ο ±ΦδΤ§≥ΛΕ»ά¥Ζ÷≈δ»ΈΈώ’Φ”ΟΥψΝΠΘ§ΒΪ≤Μ«ε≥ΰ Ι”ΟΚΈ÷÷ΖΫ ΫΨΪΉΦΒΊΩΊ÷Τ…œœ¬ΈΡ«–ΜΜΒΡ ±ΦδΓΘ÷ΒΒΟ“ΜΧαΒΡ «Θ§”…”ΎNvidia driver «≤ΜΩΣ‘¥ΒΡΘ§“ρ¥Υ–η“Σ“Μ–©ΡφœρΙΛ≥Χ≤≈Ω…“‘ΜώΒΟdriverΒΡœύΙΊmethodΒΡnameΚΆioctl≤Έ ΐΒΡΫαΙΙΓΘΗΟΖΫΑΗ‘Ύ Ι”Ο…œΕ‘”ΟΜßΩ…“‘ΉωΒΫΈόΗ–÷ΣΘ§Β±»ΜJCT «”–”ΑœλΒΡΓΘ¥ζ¬κΟΜ”–ΩΣ‘¥Θ§“≤ΟΜ”–¬έΈΡΓΘΆΦΥΡ «cGPUΒΡΦήΙΙΆΦΓΘ

ΆΦΥΡ/cgpuΦήΙΙΆΦ

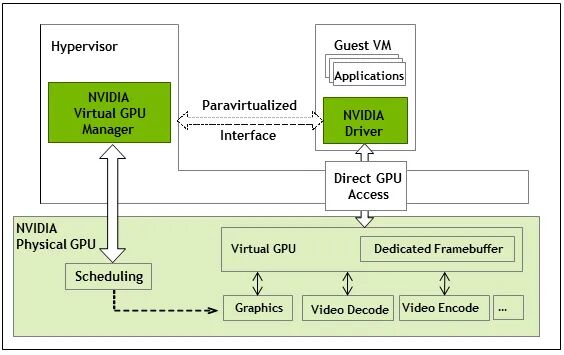

ά¥Ή‘NvidiaΒΡvGPU[8]ΤδΙ≤œμΡΘΩι‘ΎNvidia driverάοΟφΓΘvGPUΆ®Ιΐvfio-mdevΧαΙ©ΝΥ“ΜΗωΗτάκ–‘Ζ«≥ΘΗΏΒΡΒΡ”≤ΦΰΜΖΨ≥Θ§÷ς“ΣΟφœρΒΡ «–ιΡβΜζ≤ζΤΖΘ§ΈόΖ®Ε·Χ§Βς’ϊΉ ‘¥±»άΐΓΘά¥Ή‘NvidiaΒΡ≤ζΤΖΒ±»ΜΟΜ”–ΩΣ‘¥ΓΘΆΦΈε «vGPUΒΡΦήΙΙΆΦΓΘ

ΆΦΈε/vGPUΦήΙΙΆΦ

ΆΦΈε/vGPUΦήΙΙΆΦ

Fractional GPUΘ®RTAS' 19Θ©[9] «“ΜΤΣΜυ”ΎMPSΒΡΉ ‘¥ΗτάκΖΫΑΗΓΘΤδΙ≤œμΡΘΩι‘ΎNvidia driverάοΟφΓΘΗΟΖΫΑΗΒΡΗτάκΖ«≥Θ”≤Θ§ΚΥ–ΡΨΆ «ΑσΕ®ΓΘ‘ΎΦΤΥψΗτάκΖΫΟφΘ§ΥϋΆ®ΙΐΗχ»ΈΈώΑσΕ®“ΜΕ®±»άΐΒΡΩ… Ι”ΟSMΘ§ΨΆΩ…“‘Χλ»ΜΒΊ Βœ÷ΦΤΥψΗτάκΓΘMPSΒΡΦΤΥψΗτάκ «Ά®Ιΐœό÷Τ»ΈΈώΒΡthread ΐΘ§œύΫœ”ΎFractional GPUΜαœό÷ΤΒΊΗϋΦ”≤ΜΉΦ»ΖΓΘ‘Ύœ‘¥φΗτάκΖΫΟφΘ§Ής’Ώ…ν»κΒΊ―–ΨΩNvidia GPUΡΎ¥φΦήΙΙΘ®Αϋά®“Μ–©ΡφœρΙΛ≥ΧΘ©ΆΦΝυ «Fractional GPUΆ®ΙΐΡφœρΒΟΒΫΒΡNvidia GPU GTX 970ΒΡ¥φ¥ΔΧεœΒΦήΙΙΓΘΆ®Ιΐ“≥ΟφΉ≈…ΪΘ®Page ColoringΘ©ά¥Άξ≥…œ‘¥φΗτάκΓΘ“≥ΟφΉ≈…ΪΒΡΥΦœκ“≤ «ΫΪΧΊΕ®ΒΡΈοάμ“≥Ζ÷≈δΗχGPU SMΖ÷«χΘ§“‘œό÷ΤΖ÷«χΦδΜΞœύ«ά’ΦΒΡΈ ΧβΓΘΗΟΗτάκΖΫΑΗ’ϊΧε…œά¥ΥΒ”–“ΜΕ®ΥπΚΡΘ§Εχ«“÷ΜΡή Ι”ΟΙφΕ®ΚΟΒΡΉ ‘¥±»άΐΘ§≤ΜΡήΙΜΝιΜνΒΊΦλ≤βΚΆ Ι”Ο»Ϊ≤ΩΩ’œ–Ή ‘¥ΓΘΝμΆβ Ι”ΟΗΟΖΫΑΗ–η“Σ–όΗΡ”ΟΜߥζ¬κΓΘ¥ζ¬κΩΣ‘¥‘Ύ[10]ΓΘ

ΆΦΝυ/Fractional GPUΆ®ΙΐΡφœρΒΟΒΫΒΡNvidia GPU GTX 970ΒΡ¥φ¥ΔΧεœΒΦήΙΙ

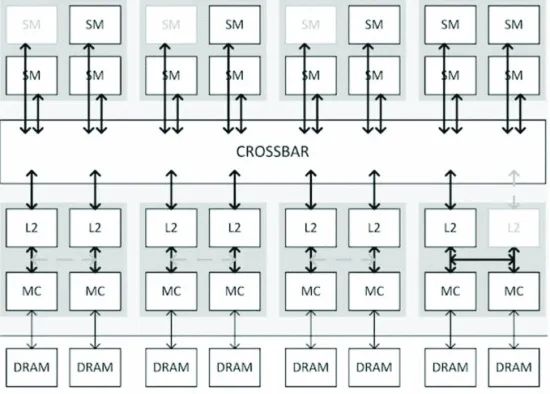

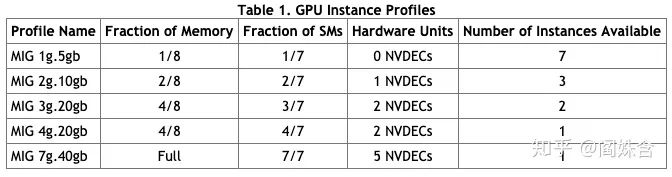

MigΘ® MULTI-INSTANCE GPUΘ©[21] «ΫώΡξA100ΜζΤς÷ß≥÷ΒΡΉ ‘¥ΗτάκΖΫΑΗΘ§Nvidia‘ΎΉνΒΉ≤ψ”≤Φΰ…œΕ‘Ή ‘¥Ϋχ––ΝΥΗτάκΘ§Ω…“‘Άξ»ΪΒΊΉωΒΫΦΤΥψ/Ά®–≈/≈δ÷Ο/¥μΈσΒΡΗτάκΓΘΥϋΫΪSMΚΆœ‘¥φΨυ‘»ΒΊΖ÷ΗχGPU instanceΘ§ΉνΕύ÷ß≥÷ΫΪSMΖ÷7ΖίΘ®“ΜΖί14ΗωΘ©Θ§œ‘¥φΖ÷8ΖίΘ®1Ζί5GBΘ©ΓΘΥ≥¥χ“ΜΧαA100”–SM108ΗωΘ§ Θœ¬ΒΡ10ΗωΫΪΈόΖ®”Ο…œΓΘΥϋΩ…―ΓΒΡ≈δ÷Ο“≤ «”–œό÷ΤΒΡΘ§»γΆΦΤΏΥυ ΨΓΘ

ΆΦΤΏ/Mig GPU Instance≈δ÷Ο≤Δ––ΡΘ Ϋ

ΆΦΤΏ/Mig GPU Instance≈δ÷Ο≤Δ––ΡΘ Ϋ≤Δ––ΡΘ Ϋ÷Η»ΈΈώ «“‘ΚΈ÷÷ΖΫ Ϋ‘ΎΆ§“ΜΗωGPU…œ‘Υ––ΒΡΓΘΡΩ«Α”–ΝΫ÷÷ΖΫ ΫΘΚΘ®1Θ©Ζ÷ ±Η¥”ΟΓΘ÷ΗΜ°Ζ÷ ±ΦδΤ§Θ§»Ο≤ΜΆ§ΒΡ»ΈΈώ’ΦΨί“ΜΗωΕάΝΔΒΡ ±ΦδΤ§Θ§–η“ΣΫχ––…œœ¬ΈΡ«–ΜΜΓΘ‘Ύ’β÷÷ΡΘ Ϋœ¬Θ§»ΈΈώ ΒΦ …œ «≤ΔΖΔΒΡΘ§Εχ≤Μ «≤Δ––ΒΡΘ§“ρΈΣΆ§“Μ ±Φδ÷Μ”–“ΜΗω»ΈΈώ‘Ύ≈ήΓΘΘ®2Θ©Κœ≤ΔΙ≤œμΓΘ÷ΗΫΪΕύΗω»ΈΈώΚœ≤Δ≥…“ΜΗω…œœ¬ΈΡΘ§“ρ¥ΥΩ…“‘Ά§ ±≈ήΕύΗω»ΈΈώΘ§ «’φ’ΐ“β“ε…œΒΡ≤Δ––ΓΘ‘Ύ…ζ≤ζΜΖΨ≥÷–Θ§ΗϋΕύ Ι”ΟΖ÷ ±Η¥”ΟΒΡΖΫ ΫΓΘ

Ζ÷ ±Η¥”Ο

Ζ÷ ±Η¥”ΟΒΡΡΘ Ϋ¥σΦ“ΕΦΫœΈΣ λœΛΘ§CPU≥Χ–ρΒΡ ±ΦδΤ§Ι≤œμ“―Ψ≠Ζ«≥Θ≥ΘΦϊΚΆ“Ή”ΟΘ§ΒΪ‘ΎGPUΝλ”ρΜΙ”–“Μ–©ΙΛΉς“ΣΉωΓΘ

»γΙϊ‘ΎNvidia GPU…œ÷±Ϋ”ΤτΕ·ΝΫΗω»ΈΈώΘ§ Ι”ΟΒΡΨΆ « ±ΦδΤ§Ι≤œμΒΡΖΫ ΫΓΘΒΪΗΟΡΘ Ϋ¥φ‘ΎΕύ»ΈΈώΗ…»≈Έ ΧβΘΚΦ¥ ΙΝΫΗωΜζΤς―ßœΑ»ΈΈώΒΡGPUάϊ”Ο¬ ΚΆœ‘¥φάϊ”Ο¬ ÷°ΚΆ‘Ε–Γ”Ύ1Θ§ΒΞΗω»ΈΈώΒΡJCT“≤ΜαΗΏ≥ωΚήΕύΓΘΨΩΤδ‘≠“ρΘ§ «“ρΈΣΦΤΥψ≈ωΉ≤Θ§Ά®–≈≈ωΉ≤Θ§“‘ΦΑGPUΒΡ…œœ¬ΈΡ«–ΜΜΫœ¬ΐΓΘΦΤΥψ≈ωΉ≤ΚήΚΟάμΫβΘ§»γΙϊ«–ΜΜΗχΝμ“ΜΗω»ΈΈώΒΡ ±ΚρΘ§±Ψ»ΈΈώ’ΐΚΟ‘ΎΉωCPUΦΤΥψ/IO/Ά®–≈Θ§Εχ–η“ΣGPUΦΤΥψ ±Θ§ ±ΦδΤ§ΨΆ«–ΜΊΗχ±Ψ»ΈΈώΘ§Ρ«Ο¥ΨΆ≤ΜΜα”–JCTΒΡ”ΑœλΓΘΒΪΝΫΗω»ΈΈώΆυΆυΆ§ ±–η“Σ Ι”ΟGPUΉ ‘¥ΓΘΆ®–≈≈ωΉ≤Θ§ «÷Η»ΈΈώΆ§ ±–η“Σ Ι”Οœ‘¥φ¥χΩμΘ§‘Ύ÷ςΜζΡΎ¥φΚΆ…η±Ηœ‘¥φ÷°Φδ¥Ϊ δ ΐΨίΓΘGPU…œœ¬ΈΡ«–ΜΜ¬ΐΘ§ «œύΕ‘CPUΕχ―‘ΒΡΓΘCPU…œœ¬ΈΡ«–ΜΜΒΡΥΌΕ» «ΈΔΟκΦΕ±πΘ§ΕχGPUΒΡ«–ΜΜ‘ΎΚΝΟκΦΕ±πΓΘ‘Ύ¥Υ¥Π“≤Μα”–“ΜΕ®ΒΡΥπΚΡΓΘΆΦΑΥ «Ζ÷ ±Η¥”ΟΡΘ ΫΒΡ≥ΘΦϊΦήΙΙΓΘ

ΆΦΑΥ/Ζ÷ ±Η¥”ΟΦήΙΙΆΦ

ΆΦΑΥ/Ζ÷ ±Η¥”ΟΦήΙΙΆΦ…œΈΡΧαΒΫΒΡGaiaΘ§KubeShareΘ§rCudaΘ§vCudaΘ§qCudaΘ§cGPUΘ§vGPUΨυΈΣΖ÷ ±Η¥”ΟΒΡΡΘ ΫΓΘ”…”Ύ…œΈΡΥυ ωΒΡΈ ΧβΘ§ΥϊΟ«ΒΡΒΞΗω»ΈΈώΆξ≥… ±ΦδΘ®JCTΘ©ΕΦΜα ήΒΫΫœ¥σΒΡ”ΑœλΓΘV100≤β ‘ΜΖΨ≥œ¬Θ§ΝΫΗω»ΈΈώΆ§ ±‘Υ––Θ§ΤδJCT «ΒΞΗω»ΈΈώ‘Υ–– ±ΒΡ1.4±Ε“‘…œΓΘ“ρ¥Υ‘Ύ…ζ≤ζΜΖΨ≥œ¬Θ§Έ“Ο«–η“ΣΩΦ¬«»γΚΈΦθ…Ό»ΈΈώ÷°ΦδΜΞœύ”ΑœλΒΡΈ ΧβΓΘ…œ ωΖΫΑΗΕΦΟΜ”–ΩΦ¬«ΜζΤς―ßœΑΒΡΧΊ–‘Θ§÷Μ“ΣΙ≤œμ≤ψΫ” ’ΒΫkernelœ¬ΖΔΘ§Φλ≤ιΟΜ”–≥§Ιΐ…η÷Ο…œœόΘ§ΨΆΜαΦΧ–χœρœ¬¥ΪΒίΓΘΝμΆβ“≤œό÷Τ»ΈΈώœ‘¥φΒΡ Ι”Ο≤ΜΡή≥§Ιΐ…η÷Ο…œœόΘ§≤ΜΨΏ±ΗΒ·–‘ΓΘ“ρ¥Υ’κΕ‘ΧΊΕ®ΒΡ…ζ≤ζ≥ΓΨΑΘ§”–“Μ–©ΙΛΉςΫαΚœΜζΤς―ßœΑ»ΈΈώΒΡΧΊ–‘Θ§Ϋχ––ΝΥΉ ‘¥ΒΡœό÷ΤΦΑ”≈Μ·ΓΘ

ΖΰΈώ÷ ΝΩΘ®QoSΘ©±Θ’œ

‘Ύ…ζ≤ζΜΖΨ≥ΒΡGPUΦ·»Κ÷–≥ΘΜα”–ΝΫάύ»ΈΈώΘ§¥ζ≥ΤΈΣΗΏ”≈œ»ΦΕ»ΈΈώΚΆΒΆ”≈œ»ΦΕ»ΈΈώΓΘΗΏ”≈»ΈΈώ « ±ΦδΟτΗ–ΒΡΘ§‘ΎΥϋ–η“ΣΉ ‘¥ ±–η“ΣΝΔΩΧΧαΙ©ΗχΥϋΓΘΕχΒΆ”≈»ΈΈώ « ±Φδ≤ΜΟτΗ–ΒΡΘ§Β±Φ·»Κ”–Ή ‘¥ΟΜ±Μ Ι”Ο ±Θ§ΨΆΩ…“‘Α≤≈≈ΥϋΧν≥δΉ ‘¥ΖλœΕ“‘ΧαΗΏΦ·»Κάϊ”Ο¬ ΓΘ“ρ¥ΥΙ≤œμΡΘΩι–η“Σ”≈œ»±Θ’œΗΏ”≈œ»ΦΕ»ΈΈώΒΡJCT≤Μ ή”ΑœλΘ§“‘œό÷ΤΒΆ”≈»ΈΈώΉ ‘¥’Φ”ΟΒΡΖΫ ΫΓΘ

BaymaxΘ®ASPLOS '16Θ©[11]Ά®Ιΐ»ΈΈώ÷Ί≈≈–ρ±Θ’œΝΥΗΏ”≈»ΈΈώΒΡQoSΓΘBaymaxΉς’Ώ»œΈΣΕύ»ΈΈώ÷°ΦδΒΡ–‘ΡήΗ…»≈Ά®≥Θ «”…≈≈Ε”―”≥ΌΚΆPCI-e¥χΩμ’υ”Ο“ΐΤπΒΡΓΘ“≤ΨΆ «ΥΒΘ§Β±ΗΏ”≈»ΈΈώ–η“ΣΦΤΥψΜρIOΆ®–≈ ±Θ§»γΙϊ”–ΒΆ”≈ΒΡ»ΈΈώ≈≈‘ΎΥϋ«ΑΟφΘ§ΗΏ”≈»ΈΈώΨΆ–η“ΣΒ»¥ΐΘ§“ρ¥ΥQoSΈόΖ®±Θ’œΓΘ’κΕ‘’βΝΫΒψBaymaxΖ÷±πΉωΝΥ“Μ–©œό÷ΤΘΚΘ®1Θ©‘Ύ≈≈Ε”―”≥ΌΖΫΟφΘ§Baymaxάϊ”ΟKNN/LRΡΘ–Άά¥‘Λ≤β≥÷–χ ±ΦδΓΘ»ΜΚσBaymaxΕ‘ΖΔΗχGPUΒΡ«κ«σΫχ––÷Ί–¬≈≈–ρΓΘΦρΒΞά¥ΥΒΘ§ΨΆ «Ι≤œμΡΘΩι‘Λ≤βΝΥΟΩΗω«κ«σΒΡ÷¥–– ±ΦδΘ§Β±Υϋ»œΈΣΖΔœ¬»ΞΒΡ«κ«σGPUΜΙΟΜ÷¥––Άξ ±Θ§–¬œ¬ΖΔΒΡ«κ«σΨΆœ»Ϋχ»κΕ”Ν–άοΓΘΆ§ ±ΫΪΈΜ”ΎΕ”Ν–÷–ΒΡ»ΈΈώ÷Ί≈≈–ρΘ§Β±–η“Σœ¬ΖΔ«κ«σ ±Θ§œ»œ¬ΖΔΕ”Ν–÷–ΒΡΗΏ”≈»ΈΈώ«κ«σΓΘΘ®2Θ©‘ΎPCI-e¥χΩμ’υ”ΟΖΫΟφΘ§Baymaxœό÷ΤΝΥ≤ΔΖΔ ΐΨί¥Ϊ δ»ΈΈώΒΡ ΐΝΩΓΘBaymaxΉς’Ώ‘ΎΒΎΕΰΡξΖΔ±μΝΥProphetΘ®ASPLOS '17Θ©[12]Θ§”Ο”Ύ‘Λ≤βΕύ»ΈΈώΙ≤÷Ο ±QoSΒΡ”Αœλ≥ΧΕ»ΓΘ‘Ύ¬έΈΡΉνΚσΧαΒΫΒΡ Β―ι÷–Θ§±μ Ψ»γΙϊ‘Λ≤βΒΫΕύΗω»ΈΈώ≤ΜΜα”ΑœλQoSΘ§ΨΆΫΪΤδΙ≤÷ΟΘ§ΒΪ¥Υ¥ΠΙ≤÷Ο Ι”ΟΒΡ «MPSΘ§“≤ΨΆ «ΟΜ”– Ι”ΟΖ÷ ±Η¥”ΟΒΡΡΘ ΫΝΥΓΘ‘ΎΗΟ―–ΨΩ÷–Θ§‘Λ≤β «ΚΥ–ΡΓΘ‘Λ≤βΉΦ»Ζ–‘ «ΖώΡή ”ΠΗ¥‘”ΒΡ…ζ≤ζΜΖΨ≥Θ§‘Λ≤βΒΡΜζΤςΗΚ‘Ί «ΖώΫœ¥σΘ§ΜΙ‘ί≤Μ«ε≥ΰΓΘ

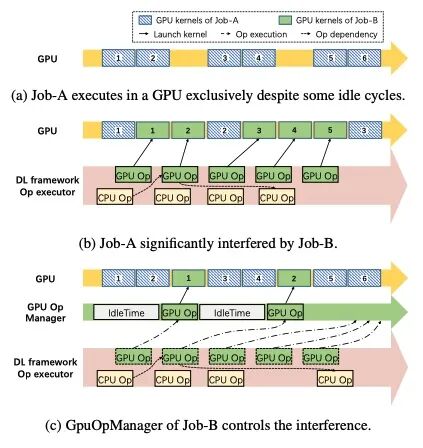

ά¥Ή‘ΑΔάοΒΡAntManΘ®OSDI '20Θ©[13]“≤»œΈΣ≈≈Ε”―”≥ΌΚΆ¥χΩμ’υ”Ο «Η…»≈ΒΡ‘≠“ρΘ§≤ΜΆ§ΒΡ «Θ§Υϋ¥”DLΡΘ–ΆΒΡΧΊΒψ«–»κΘ§ά¥«χΖ÷«–ΜΜΒΡ ±ΜζΓΘ

‘ΎΥψΝΠœό÷ΤΖΫΟφΘ§AntManΆ®Ιΐœό÷ΤΒΆ”≈»ΈΈώΒΡkernel launch±Θ÷ΛΝΥΗΏ”≈»ΈΈώΒΡQoSΓΘΆΦΨ≈ «AntManΥψΝΠΙ≤œμΜζ÷ΤΒΡΕ‘±»ΓΘAntManΥψΝΠΒςΕ»Ήν–ΓΒΞ‘ΣΘ§‘Ύ¬έΈΡ÷–Οη ωΥΤΚθ”––©ΡΘΚΐΘ§”ΠΗΟ «OpΘ®OperatorΘ©Θ§AntManΓΑΜα≥÷–χΖ÷ΈωGPU‘ΥΥψΖϊΒΡ÷¥–– ±ΦδΓΑΘ§≤Δ‘ΎΩ’œΕ ±≤ε»κΝμ“ΜΗω»ΈΈώΒΡOpΓΘΒΪ»γΚΈ≥÷–χΖ÷ΈωΘ§¬έΈΡ÷–≤ΔΟΜ”–œξœΗΟη ωΓΘ‘Ύœ‘¥φΗτάκΖΫΟφΘ§AntManΟΜ”–œό÷Τœ‘¥φΒΡ¥σ–ΓΘ§Εχ «ΨΓΝΠ»ΟΝΫΗω»ΈΈώΕΦΡή‘Υ––‘ΎΜζΤς…œΓΘΒΪΝΫΗωΜρΕύΗω»ΈΈώΒΡœ‘¥φ…ξ«κΝΩΩ…ΡήΜα‘λ≥…œ‘¥φ“γ≥ωΘ§“ρ¥ΥAntManΉωΝΥΚήΕύœ‘¥φΖΫΟφΒΡΙΛΉςΓΘ Ήœ»–η“ΣΝΥΫβ»ΈΈώ‘Ύœ‘¥φ÷–±Θ¥φΒΡΡΎ»ίΘΚ Ήœ» «ΡΘ–ΆΘ§ΗΟ ΐΨί «¥σ–ΓΈ»Ε®ΒΡΘ§Β±Υϋ‘Ύœ‘¥φ÷– ±Θ§iteration≤≈Ω…“‘ΩΣ ΦΦΤΥψΓΘ¬έΈΡ÷–±μ Ψ90%ΒΡ»ΈΈώΡΘ–Ά Ι”Ο500mb“‘ΡΎΒΡœ‘¥φΓΘΤδ¥Έ «iterationΩΣ Φ ±…ξ«κΒΡΝΌ ±œ‘¥φΘ§’β≤ΩΖ÷œ‘¥φάμ¬έ…œά¥ΥΒΘ§‘ΎiterationΫα χΚσΨΆΜα ΆΖ≈ΓΘΒΪ Ι”ΟΒΡΜζΤς―ßœΑΩρΦή”–ΜΚ¥φΜζ÷ΤΘ§…ξ«κΒΡœ‘¥φ≤ΜΜαΆΥΜΊΘ§ΗΟΧΊ–‘±Θ’œΝΥΥΌΕ»Θ§ΒΪΈΰ…ϋΝΥΙ≤œμΒΡΩ…Ρή–‘ΓΘ“ρ¥ΥAntManΉωΝΥ“Μ–©œ‘¥φΖΫΟφΉνΚΥ–ΡΒΡΜζ÷Τ «Θ§Β±œ‘¥φΖ≈≤Μœ¬ ±Θ§ΨΆΉΣΒΫΡΎ¥φ…œΓΘ‘Ύ¥Υ¥Π¬έΈΡΜΙΉωΝΥΚήΕύΙΛΉςΘ§≤Μ‘ΌΨΓ ωΓΘ

¬έΈΡΟη ω≥ΤAntManΩ…“‘Ιφ±ήΉήœΏ¥χΩμ’υ”ΟΈ ΧβΘ§ΒΪΥΤΚθ¥”Μζ÷Τ…œά¥ΥΒΈόΖ®±ήΟβΓΘ≥ΐ¥Υ÷°ΆβΘ§Α¥’’OpΈΣΝΘΕ»Ϋχ––ΥψΝΠΗτάκ «ΖώΜα–η“Σ¥σΝΩΒςΕ»ΗΚ‘Ί“≤ «“ΜΗω“…Έ Θ§ΝμΆβOp÷¥–– ±ΦδΒΡ≤ν“λ–‘Ϋœ¥σΘ§”»Τδ «ΩΣΤτXLA÷°ΚσΘ§’β“≤Ω…Ρή¥χά¥“Μ–©≤Μ»ΖΕ®–‘ΓΘΗΟΖΫΑΗ–η“Σ–όΗΡΜζΤς―ßœΑΩρΦήΘ®TensorflowΚΆPytorchΘ©Θ§Ε‘”ΟΜß”–“ΜΕ®ΒΡ”ΑœλΓΘ¥ζ¬κΩΣ‘¥‘Ύ[20]Θ§ΡΩ«ΑΜΙ «WIPœνΡΩΘ®ΫΊ÷Ι2020/11/18Θ©Θ§ΚΥ–Ρ≤ΩΖ÷Θ®local-coordinatorΘ©ΜΙΟΜΡήΩΣ‘¥ΓΘ

ΆΦΨ≈/AntManΥψΝΠΙ≤œμΜζ÷ΤΒΡΕ‘±»

ΆΦΨ≈/AntManΥψΝΠΙ≤œμΜζ÷ΤΒΡΕ‘±»»γΙϊΉν–ΓΒςΕ»ΒΞ‘Σ «iterationΘ§‘ρΜαΗϋΦ”ΦρΒΞΓΘ Ήœ»–η“ΣΝΥΫβ“Μœ¬DL―ΒΝΖΒΡΧΊ’ςΘΚ―ΒΝΖ ±ΒΡΉν–ΓΒϋ¥ζ «“ΜΗωiterationΘ§Ζ÷ΈΣΥΡΗωΙΐ≥ΧΘΚIOΘ§Ϋχ–– ΐΨίΕΝ»Γ¥φ¥Δ“‘ΦΑ“Μ–©ΝΌ ±±δΝΩΒΡ…ξ«κΒ»ΘΜ«ΑœρΘ§‘Ύ¥ΥΙΐ≥Χ÷–Μα”–ΟήΦ·ΒΡGPU kernelΓΘNLP»ΈΈώ‘Ύ¥Υ¥Π“≤Μα”–CPUΗΚ‘ΊΓΘΚσœρΘ§ΦΤΥψΧίΕ»Ηϋ–¬Θ§–η“Σœ¬ΖΔGPU kernelΘΜΗϋ–¬Θ§»γΙϊΖ«“ΜΜζ“ΜΩ®ΒΡ»ΈΈώΘ§Μα”–Ά®–≈ΒΡΙΐ≥ΧΓΘ÷°ΚσΗϋ–¬Κœ≤ΔΚσΒΡΧίΕ»Θ§–η“Σ“Μ–ΓΕΈGPU ±ΦδΓΘΩ…“‘Ω¥≥ω«ΑœρΚσœρΚΆΆ®–≈÷°ΚσΒΡΗϋ–¬Ιΐ≥ΧΘ§ «–η“Σ Ι”ΟGPUΒΡΘ§Ά®–≈ΚΆIO≤Μ–η“ΣΓΘ“ρ¥ΥΩ…“‘‘Ύ¥Υ¥Π≤ε»κ“Μ–©ά¥Ή‘ΤδΥϊ»ΈΈώΒΡkernelΘ§Ά§ ±ΜΙΩ…“‘±Θ÷Λ±Μ≤ε»κ»ΈΈώΒΡQoSΓΘΗϋΦρΒΞΒΡΖΫ Ϋ «Θ§Ά®Ιΐ‘Ύiteration«ΑΚσ≤ε»κΝμ“ΜΗω»ΈΈώΒΡiterationά¥Άξ≥…Ι≤œμΓΘΒ±»Μ’β―υΨΆΈόΖ®ΩΦ¬«Ά®–≈ΒΡΩ’œΕΘ§Ω…“‘±ΜάμΫβ «“Μ÷÷tradeoffΓΘΝμΆβ“≤“ρΈΣiteration «Ήν–ΓΒςΕ»ΒΞ‘ΣΘ§±ήΟβΝΥΦΤΥψΉ ‘¥ΚΆœ‘¥φ¥χΩμ’υ”ΟΈ ΧβΓΘΝμΆβΘ§»γΙϊ≤ΜΩΦ¬«ΗΏ”≈»ΈΈώΘ§ Βœ÷“ΜΗωΆΥΜ·Αφ±ΨΘ§ΧΑ–ΡΒΊΖ≈÷ΟiterationΕχ≤ΜΦ”“‘œό÷ΤΓΘΩ…“‘ΗϋΦρΒΞΒΊΧαΗΏΦ·»Κάϊ”Ο¬ Θ§“≤Ω…“‘»Ο»ΈΈώΒΡJCT/≈≈Ε” ±ΦδΦθ–ΓΓΘ

’κΕ‘ΆΤάμΒΡ…œœ¬ΈΡ«–ΜΜ

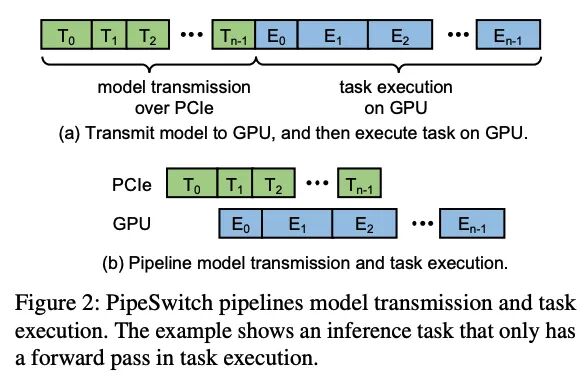

‘Ύ…œΈΡ÷–Οη ωΝΥΖ÷ ±Η¥”ΟΒΡ»ΐΗωΈ ΧβΘ§Τδ÷–…œœ¬ΈΡ«–ΜΜ «“ΜΗωΚΡ ±ΒψΓΘά¥Ή‘Ή÷ΫΎΧχΕ·ΒΡPipeSwitchΘ®OSDI '20Θ©[14]’κΕ‘ΆΤάμ≥ΓΨΑΒΡ…œœ¬ΈΡ«–ΜΜΫχ––ΝΥ”≈Μ·ΓΘΨΏΧε…ζ≤ζ≥ΓΨΑ «’β―υΒΡΘΚ―ΒΝΖΆΤάμ»ΈΈώΙ≤œμ“Μ’≈Ω®Θ§¥σΕύ ΐ ±Κρ―ΒΝΖ Ι”ΟΉ ‘¥ΓΘΒ±ΆΤάμ«κ«σœ¬ΖΔΘ§…œœ¬ΈΡ–η“ΣΝΔΩΧ«–ΜΜΒΫΆΤάμ»ΈΈώΓΘ»γΙϊΡΘ–Ά ΐΨί“―Ψ≠‘Ύœ‘¥φ÷–Θ§«–ΜΜΜαΚήΩλΘ§ΒΪ…ζ≤ζΜΖΨ≥÷–ΡΘ–Ά“ΜΑψΫœ¥σΘ§―ΒΝΖΚΆΆΤάμΒΡΡΘ–Ά≤ΜΡήΆ§ ±Φ”‘ΊΒΫœ‘¥φ÷–Θ§Β±«–ΜΜΒΫΆΤάμ ±Θ§–η“Σœ»¥Ϊ δ’ϊΗωΡΘ–ΆΘ§“ρ¥ΥΥΌΕ»Ϋœ¬ΐΓΘ

‘ΎΗΟ≥ΓΨΑœ¬Θ§GPU…œœ¬ΈΡ«–ΜΜΒΡΩΣœζ”–ΘΚΘ®1Θ©»ΈΈώ«εάμΘ§÷Η ΆΖ≈œ‘¥φΓΘΘ®2Θ©»ΈΈώ≥θ ΦΜ·Θ§÷ΗΤτΕ·Ϋχ≥ΧΘ§≥θ ΦΜ·Cuda contextΒ»ΓΘΘ®3Θ©MallocΓΘΘ®4Θ©ΡΘ–Ά¥Ϊ δΘ§¥”ΡΎ¥φ¥ΪΒΫœ‘¥φΓΘ

‘ΎΡΘ–Ά¥Ϊ δΖΫΟφΘ§PipeSwitchΉς’ΏΙέ≤λΒΫΘ§ΚΆ―ΒΝΖ≤ΜΆ§ΒΡ «ΆΤάμ÷Μ”–«ΑœρΙΐ≥ΧΘ§“ρ¥Υ÷Μ–η“Σ÷ΣΒά…œ“Μ≤ψΒΡ δ≥ωΦΑ±Ψ≤ψΒΡ≤Έ ΐΨΆΩ…“‘ΩΣ ΦΦΤΥψ±Ψ≤ψΓΘΡΩ«ΑΒΡΦ”‘ΊΖΫ Ϋ «Θ§ΫΪΡΘ–Ά ΐΨί»Ϊ≤ΩΦ”‘ΊΒΫœ‘¥φΚσΘ§≤≈ΜαΩΣ ΦΫχ––ΦΤΥψΘ§ΒΪ ΒΦ …œ»γΙϊΕ‘IOΚΆΦΤΥψΉωpipelineΘ§÷ΜΦ”‘Ί“Μ≤ψΨΆΩΣ ΦΦΤΥψΗΟ≤ψΘ§ΨΆΜαΦ”Ωλ’ϊΧεΥΌΕ»ΓΘΒ±»Μ÷±Ϋ” Ι”Ο≤ψΈΣΉν–ΓΝΘΕ»Ω…ΡήΜα¥χά¥Ϋœ¥σΩΣœζΘ§“ρ¥ΥΫχ––ΝΥgroupingΚœ≤Δ≤ΌΉςΓΘΆΦ °œ‘ ΨΝΥpipelineΒΡΕ‘±»ΓΘ‘Ύ»ΈΈώ«εάμΚΆ≥θ ΦΜ·ΖΫΟφΘ§…η÷ΟΝΥ“Μ–©≥ΘΉΛΫχ≥Χά¥±ήΟβΩΣœζΓΘΉνΚσ‘ΎMallocΖΫΟφ“≤ Ι”ΟΝΥΆ≥“ΜΒΡΡΎ¥φΙήάμά¥ΫΒΒΆΩΣœζΓΘΩ…“‘ΥΒΉωΒΡΖ«≥Θ»ΪΟφΓΘ”…”Ύ–η“ΣΜώ÷Σ≤ψΦΕΫαΙΙΘ§“ρ¥Υ–η“ΣΕ‘PytorchΩρΦήΫχ–––όΗΡΘ§Ε‘”ΟΜß”–“ΜΕ®”ΑœλΓΘ¥ζ¬κΩΣ‘¥‘Ύ[19].

ΆΦ °/PipeSwitch pipelineΒΡΕ‘±»

ΆΦ °/PipeSwitch pipelineΒΡΕ‘±»

Κœ≤ΔΙ≤œμ

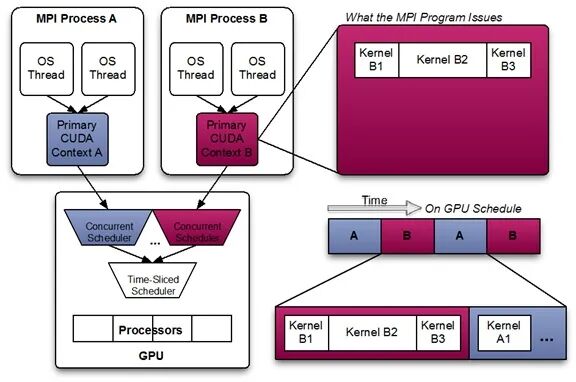

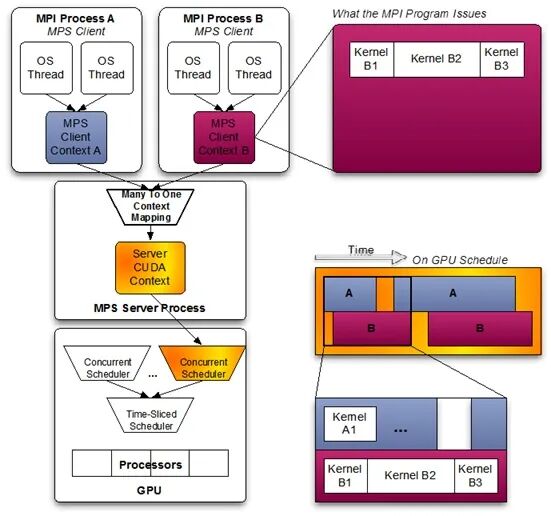

Κœ≤ΔΙ≤œμ «÷ΗΘ§ΕύΗω»ΈΈώΚœ≤Δ≥…“ΜΗω…œœ¬ΈΡΘ§“ρ¥ΥΩ…“‘Ι≤œμGPUΉ ‘¥Θ§Ά§ ±ΖΔΥΆkernelΒΫGPU…œΘ§“≤Ι≤Ά§ Ι”Οœ‘¥φΓΘΉνΨΏ”–¥ζ±μ–‘ΒΡ «NvidiaΒΡMPS[15]ΓΘΗΟΡΘ ΫΒΡΚΟ¥Π «œ‘Εχ“ΉΦϊΒΡΘ§Β±»ΈΈώ Ι”ΟΒΡΉ ‘¥Ω…“‘Ά§ ±±Μ¬ζΉψ ±Θ§ΤδJCTΨΆΜυ±ΨΟΜ”–”ΑœλΘ§–‘ΡήΩ…“‘ΥΒ «ΉνΚΟΒΡΓΘΩ…“‘≥δΖ÷άϊ”ΟGPUΉ ‘¥ΓΘΒΪΜΒ¥Π“≤ «÷¬ΟϋΒΡΘΚ¥μΈσΜαΜΞœύ”ΑœλΘ§»γΙϊ“ΜΗω»ΈΈώ¥μΈσΆΥ≥ωΘ®Αϋά®±ΜkillΘ©Θ§»γΙϊΗΟ»ΈΈώ’ΐ‘Ύ÷¥––kernelΘ§Ρ«Ο¥ΚΆΗΟ»ΈΈώΙ≤Ά§share IPCΚΆUVMΒΡ»ΈΈώ“≤Μα“ΜΆ§≥ω¥μΆΥ≥ωΓΘΡΩ«ΑΜΙΟΜ”–ΙΛΉςΡήΙΜΫβΨω’β“ΜΈ ΧβΘ§NvidiaΙΌΖΫ“≤ΆΤΦω Ι”ΟMPSΒΡ»ΈΈώ–η“ΣΡήΙΜΫ” ή¥μΈσ”ΑœλΘ§±»»γMPI≥Χ–ρΓΘ“ρ¥ΥΈόΖ®‘Ύ…ζ≤ζ≥ΓΨΑ…œ¥σΙφΡΘ Ι”ΟΓΘΝμΆβΘ§”–±®Ηφ≥ΤΤδ≤ΜΡή÷ß≥÷Υυ”–DLΩρΦήΒΡΥυ”–Αφ±ΨΓΘ

‘ΎΉ ‘¥ΗτάκΖΫΟφΘ§MPSΟΜ”–œ‘¥φΗτάκΘ§Ω…“‘Ά®Ιΐœό÷ΤΆ§ ±œ¬ΖΔΒΡthread ΐ¥÷¬‘ΒΊœό÷ΤΦΤΥψΉ ‘¥ΓΘΥϋΈΜ”ΎNvidia Driver÷°…œΓΘΆΦ °“Μ «MPSΒΡΦήΙΙΆΦΓΘ

ΆΦ °“Μ/MPSΦήΙΙΆΦ

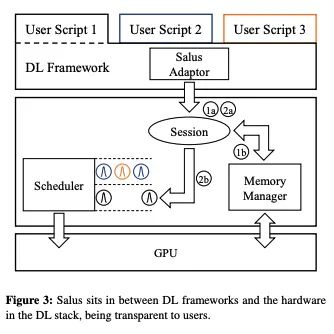

ΆΦ °“Μ/MPSΦήΙΙΆΦSalusΘ®MLSys '20Θ©[16]“≤≤…»ΓΝΥΚœ≤ΔΙ≤œμΒΡΖΫ ΫΘ§Ής’ΏΆ®ΙΐAdaptorΫΪGPU«κ«σΚœ≤ΔΒΫΆ§“ΜΗωcontextœ¬Θ§»ΞΒτΝΥ…œœ¬ΈΡ«–ΜΜΓΘΒ±»ΜΘ§ΚΆMPS“Μ―υΜαΖΔ…ζ¥μΈσ¥Ϊ≤ΞΘ§¬έΈΡ÷–“≤ΟΜ”–“ΣΫβΨω’β“ΜΈ ΧβΘ§“ρ¥ΥΈόΖ®‘Ύ…ζ≤ζΜΖΨ≥÷– Ι”ΟΓΘΒΪ± ’Ώ»œΈΣ’βΤΣ¬έΈΡ÷–Ηϋ¥σΒΡΦέ÷Β‘Ύœ‘¥φΚΆΒςΕ»ΖΫΟφΘ§ΥϋΒΡΚήΕύΦϊΫβ‘ΎAntManΚΆPipeSwitch÷–“≤”–Χεœ÷ΓΘΒςΕ»ΖΫΟφΘ§“‘iterationΈΣΉν–ΓΝΘΕ»Θ§≤Δ«“ΎΙ ΆΝΥ‘≠“ρΘΚ Ι”ΟkernelΈΣΝΘΕ»Θ§Ω…“‘Ϋχ“Μ≤Ϋάϊ”ΟΉ ‘¥Θ§ΒΪΜα‘ωΦ”ΒςΕ»ΖΰΈώΒΡΩΣœζΓΘ“ρ¥Υ’έ÷–―Γ‘ώΝΥiterationΘ§Ω…“‘ Βœ÷–‘ΡήΉν¥σΜ·ΓΘœ‘¥φΖΫΟφΘ§“Μ–©Ιέ≤λΚΆAntMan «“Μ÷¬ΒΡΘΚœ‘¥φ±δΜ·ΨΏ”–÷ήΤΎ–‘ΘΜ”άΨΟ–‘œ‘¥φΘ®ΡΘ–ΆΘ©Ϋœ–ΓΘ§÷Μ“ΣΡΘ–Ά‘Ύœ‘¥φ÷–ΨΆΩ…“‘ΩΣ ΦΦΤΥψΘΜΝΌ ±–‘œ‘¥φ‘ΎiterationΫα χΚσΨΆ”ΠΗΟ ΆΖ≈ΓΘ“≤Οη ωΝΥΜζΤς―ßœΑΩρΦήΜΚ¥φΜζ÷ΤΒΡΥάΥχΈ ΧβΓΘ≤ΜΙΐSalus Βœ÷…œ–η“ΣΝΫΗω»ΈΈώΥυ–ηΒΡœ‘¥φΕΦΖ≈ΒΫGPUœ‘¥φάοΘ§ΟΜ”–÷ΟΜΜΒΡ≤ΌΉςΓΘ¬έΈΡ÷–“≤ΧαΒΫΝΥΆΤάμ≥ΓΨΑœ¬ΒΡ«–ΜΜΈ ΧβΘΚ«–ΜΜΚσάμ¬έ…œΡΘ–Ά¥Ϊ δ ±Φδ±»ΆΤάμ―”≥Ό±Ψ…μ≥ΛΦΗ±ΕΓΘ≥ΐ¥Υ÷°Άβ¬έΈΡ÷–“≤”–“Μ–©ΤδΥϊΒΡΙέ≤λΒψΘ§÷ΒΒΟ“ΜΩ¥ΓΘΆΦ °Εΰ’Ι ΨΝΥSalusΦήΙΙΓΘΗΟœνΡΩ¥ζ¬κΩΣ‘¥‘Ύ[17]ΓΘSalus“≤–η“Σ–όΗΡDLΩρΦήΓΘΉς’Ώ“≤ΩΣ‘¥ΝΥ–όΗΡΚσΒΡtensorflow¥ζ¬κΓΘ

ΆΦ °Εΰ/SalusΦήΙΙΆΦ

»γΙϊ‘ΎΚœ≤ΔΙ≤œμΡΘΩι÷°…œΉωΖ÷ ±Η¥”ΟΘ§”ΠΩ…“‘»ΤΙΐ”≤ΦΰΒΡœό÷ΤΘ§ΨΪΉΦΒΊΩΊ÷Τ ±ΦδΤ§ΚΆ«–ΜΜΒΡ ±ΜζΘ§“≤Ω…“‘»Ξ≥ΐ…œœ¬ΈΡ«–ΜΜΒΡΩΣœζΓΘΒΪ‘Ύ’β÷÷«ιΩωœ¬ «ΖώΜΙΜα”–¥μΈσ”ΑœλΘ§ΜΙ–η“ΣΫχ“Μ≤Ϋ―ι÷ΛΓΘ

≥ΓΨΑ’ΙΆϊΡΩ«ΑGPUΙ≤œμ“―Ψ≠÷πΫΞΩΣ ΦΫχ»κΙΛ“Β¬δΒΊΒΡΫΉΕΈΝΥΘ§»τ–η“ΣΗϋΚΟΒΊ¬ζΉψ”ΟΜßΕ‘ Ι”Ο≥ΓΨΑΒΡΤΎ¥ΐΘ§≥ΐΝΥΗϋΗΏΒΡ–‘ΡήΘ§± ’Ώ»œΈΣ“‘œ¬ΦΗΒψ“≤–η“ΣΉΔ“βΓΘ

- ΡήΙΜΧαΙ©Έ»Ε®ΒΡΖΰΈώΘ§‘ΥΈ§±ψΫίΓΘ±»»γMPSΒΡ¥μΈσ”Αœλ «≤ΜΡή±ΜΫ” ήΒΡΘ§ΝμΆβΕ‘”Ύ¥χ”–‘Λ≤βΒΡ Βœ÷Θ§“≤–η“ΣΗϋΗΏΒΡΈ»Ε®–‘ΓΘΙ≤œμΙΛΉςΗΚ‘ΊΨΓΝΩΫΒΒΆΓΘ

- ΗϋΒΆΒΡJCT ±―”Θ§ΉνΚΟΨΏ”–±Θ’œ≤ΩΖ÷»ΈΈώQoSΒΡΡήΝΠΓΘΕ‘”Ύ“ΜΗω“―”–ΒΡGPUΦ·»ΚΫχ––ΗΡ‘λ ±Θ§–η“ΣΨΓΝΩΦθ…ΌΕ‘“―”–ΒΡ”ΟΜßΚΆ»ΈΈώΒΡ”ΑœλΓΘ

- ≤Μ¥ρ»≈”ΟΜßΘ§ΨΓΝΩ≤ΜΕ‘”ΟΜßΒΡ¥ζ¬κΚΆΩρΦήΒ»Ήω–όΗΡΘ§ΝμΆβ“≤–η“ΣΩΦ¬«ΩρΦήΚΆΤδΥϊΩβΒΡΗϋ–¬Έ ΧβΓΘ